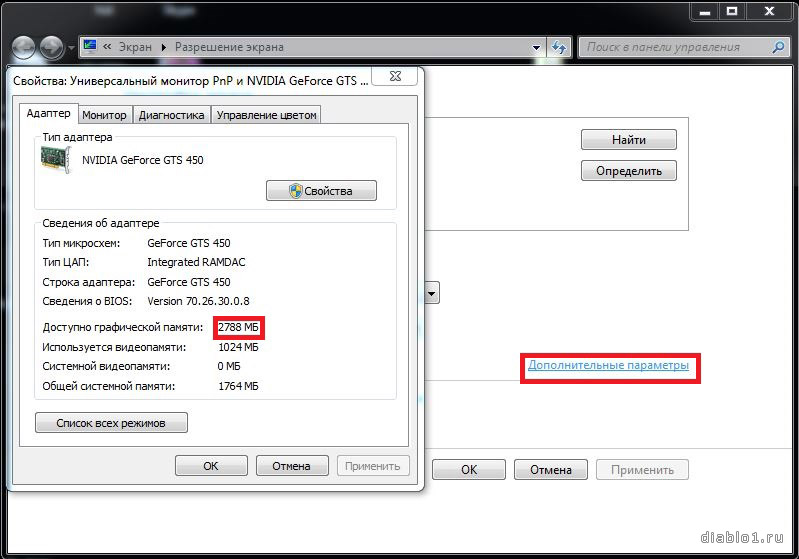

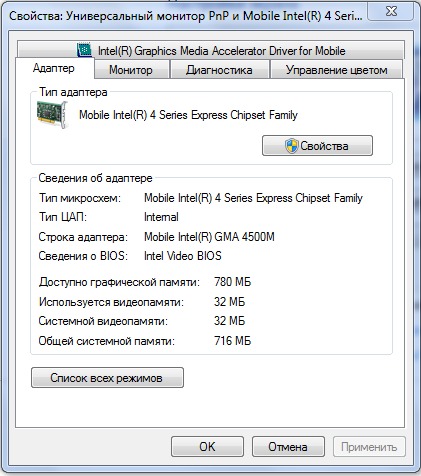

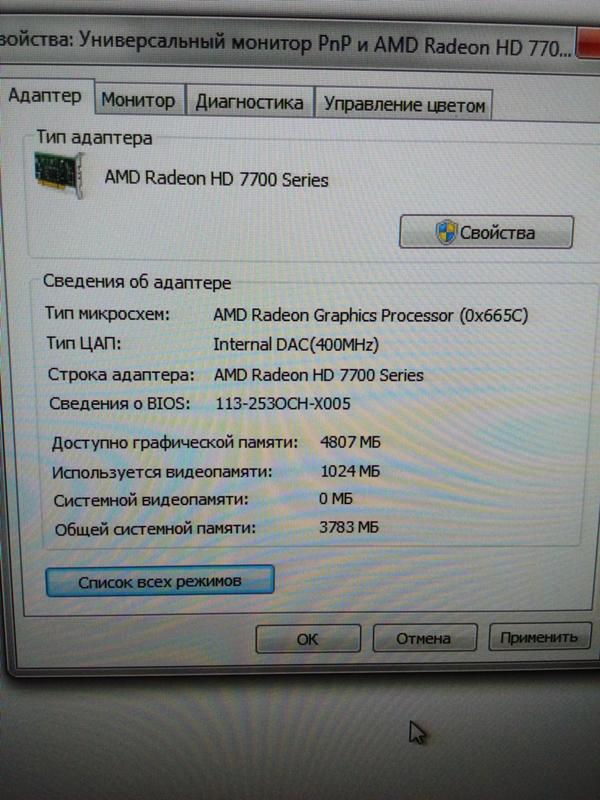

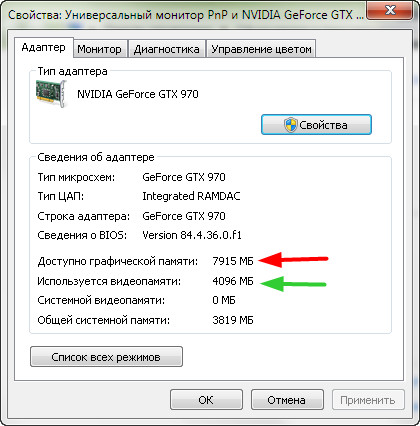

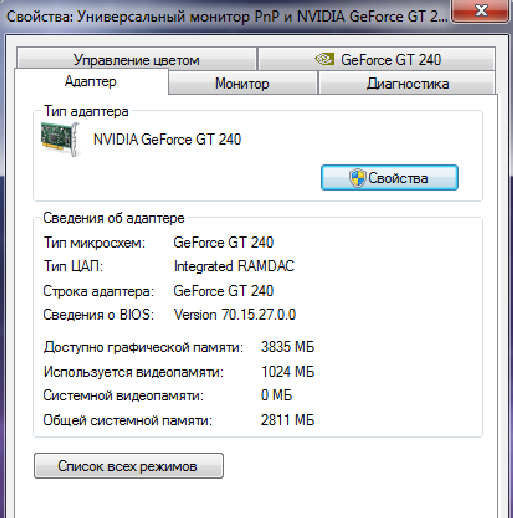

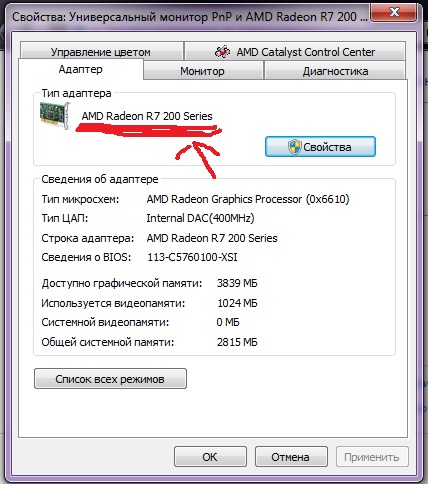

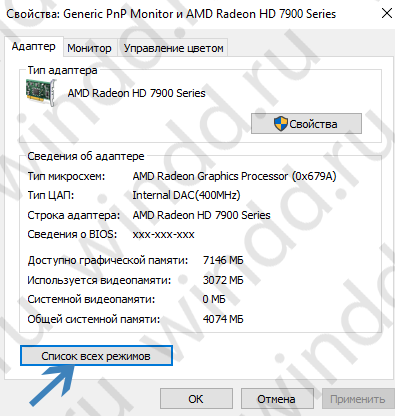

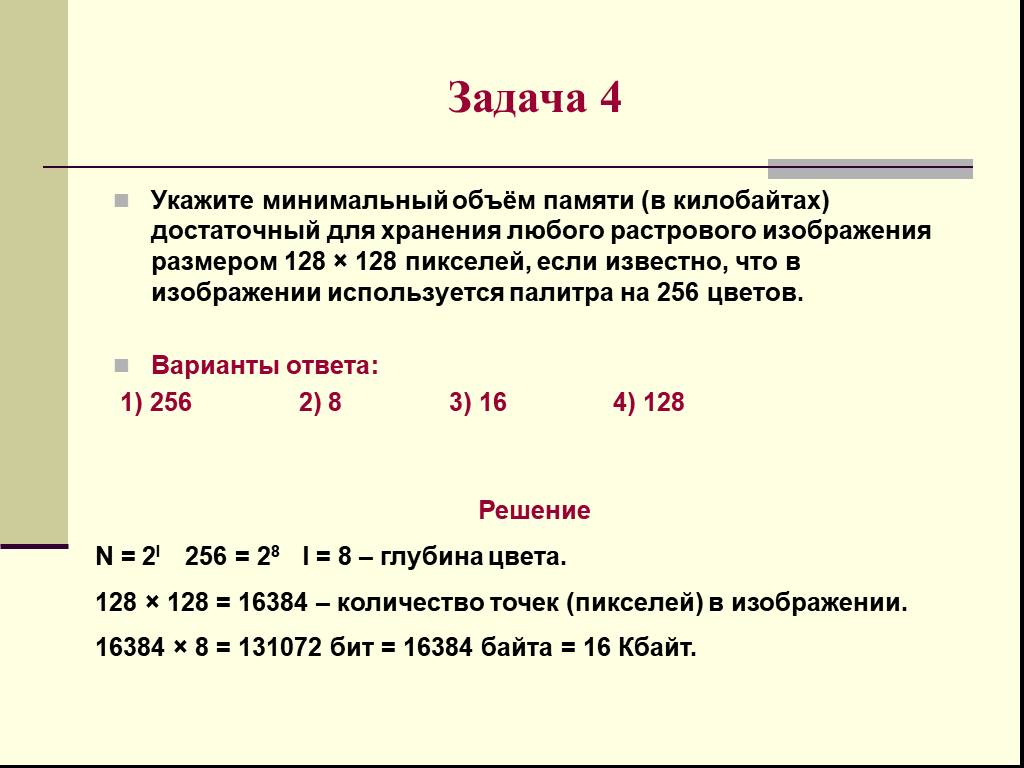

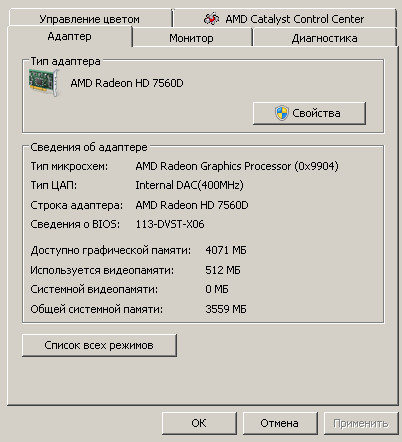

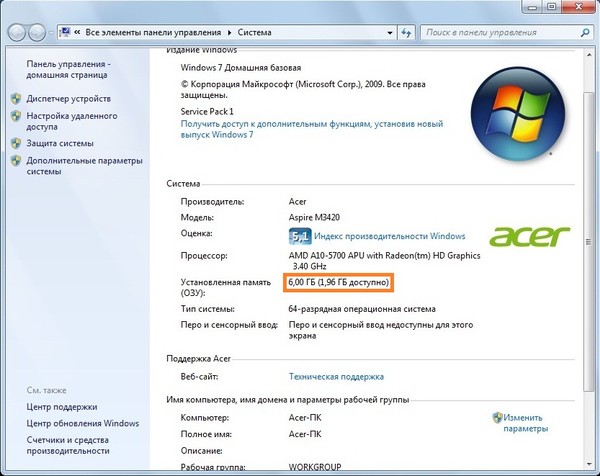

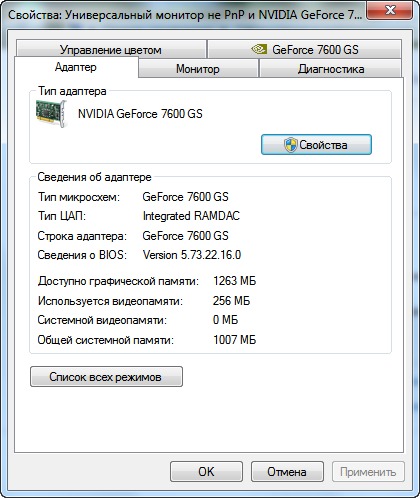

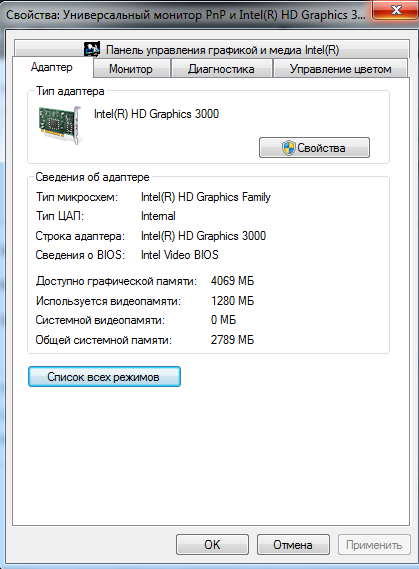

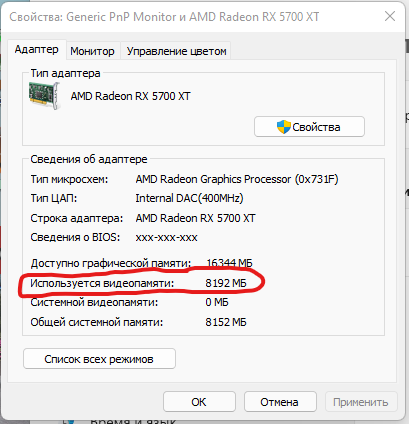

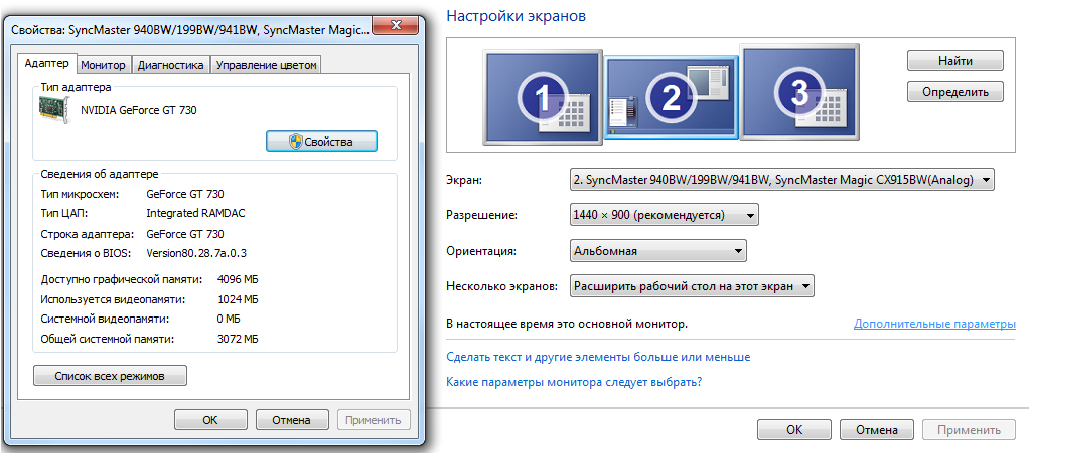

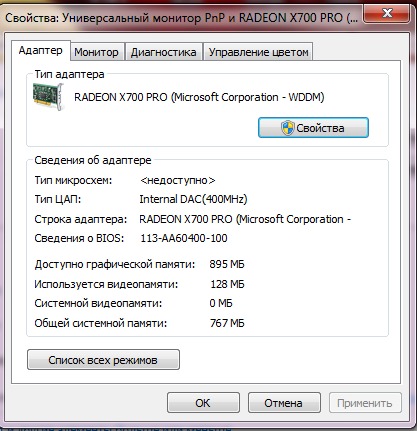

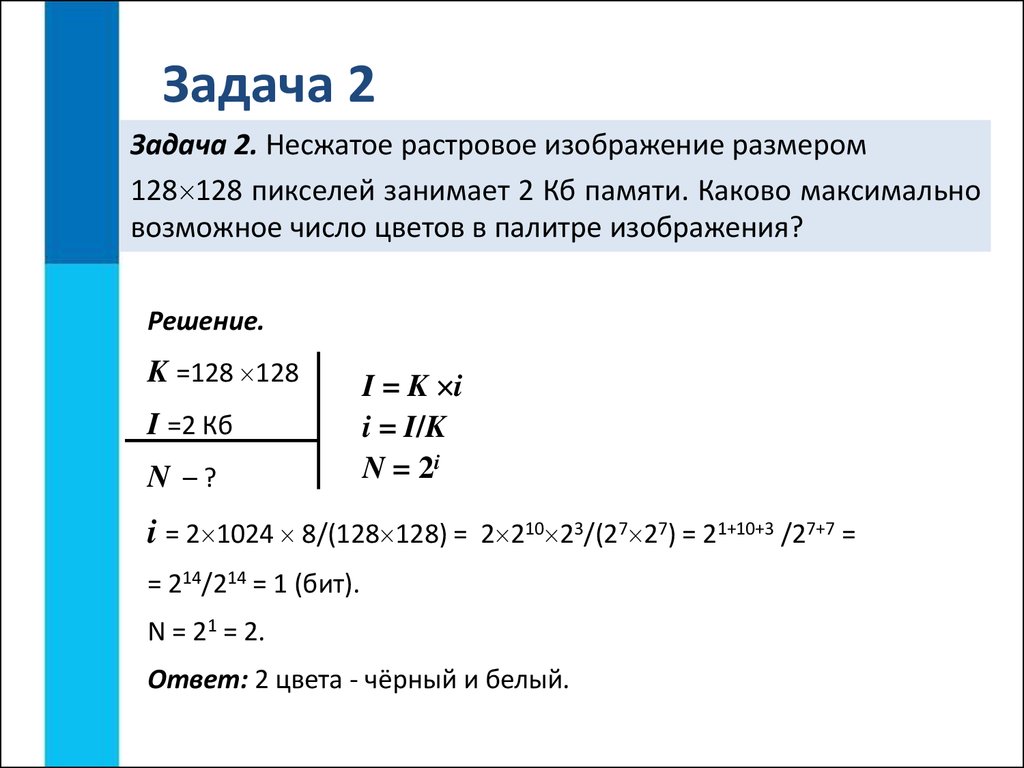

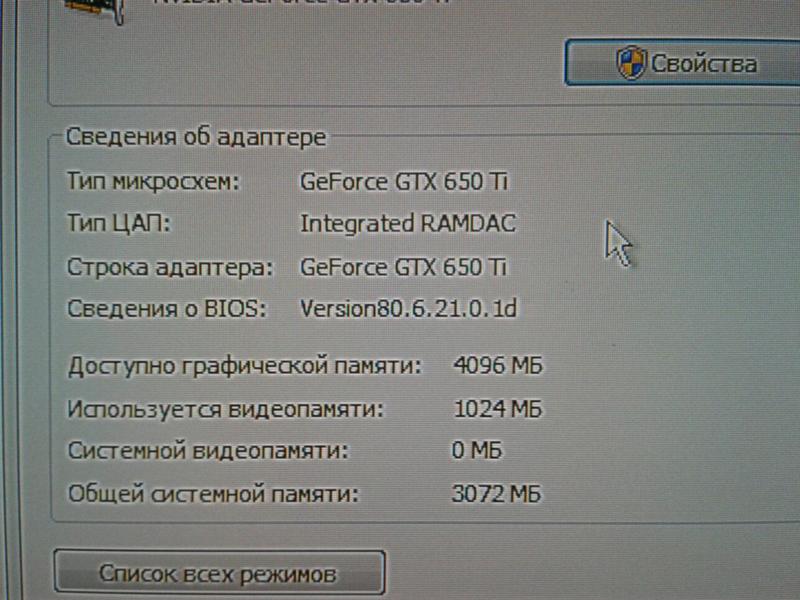

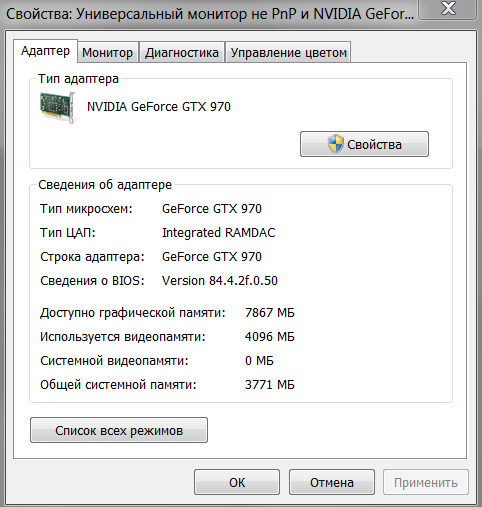

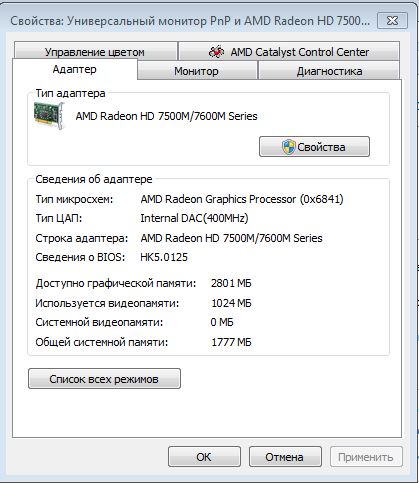

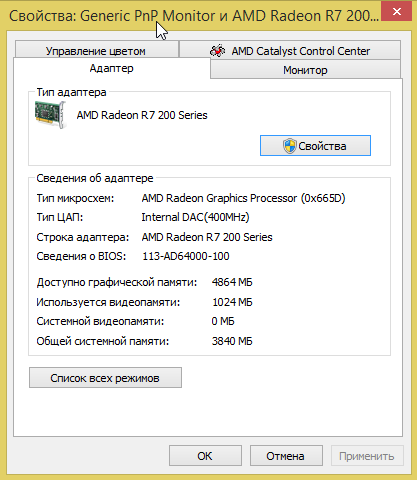

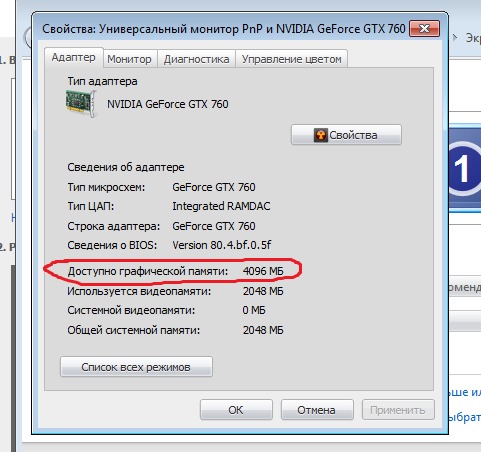

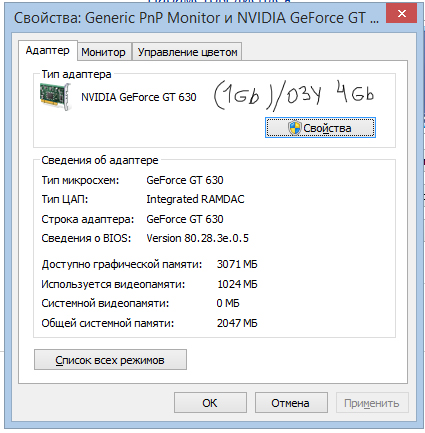

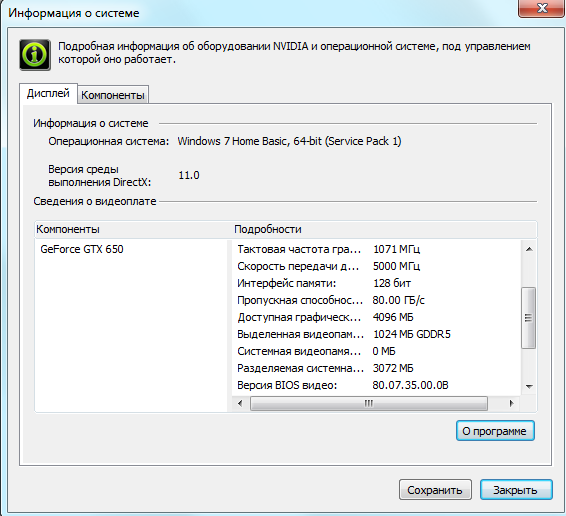

Доступно графической памяти 4096 используется 1024

Видеопамять

Видеопамять также является частью современных видеокарт. Подробнее см. в статье «Видеокарта».

Видеопамять — это внутренняя оперативная память, отведённая для хранения данных, которые используются для формирования изображения на экране монитора.

Видеопамять относится к названиям англ. video memory, video Random-Access Memory (video RAM, VRAM — оперативная видеопамять, видео ОЗУ, видео RAM), video buffer — видеобуфер, refresh RAM — память регенерации, display memory — память дисплея, graphics memory, video storage, а также к названиям различных типов памяти. Термин «VRAM» иногда означает технологию двухпортовой DRAM, использовавшуюся в 1980-х годах.

Описание

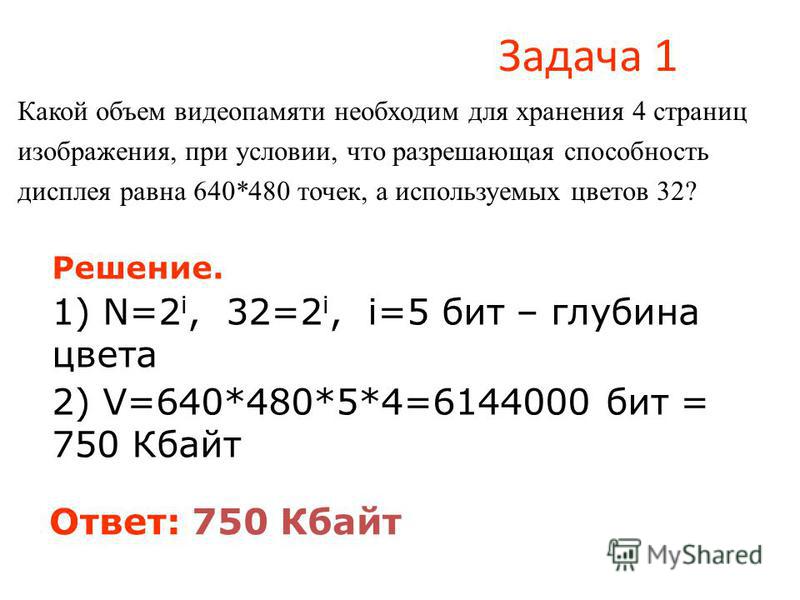

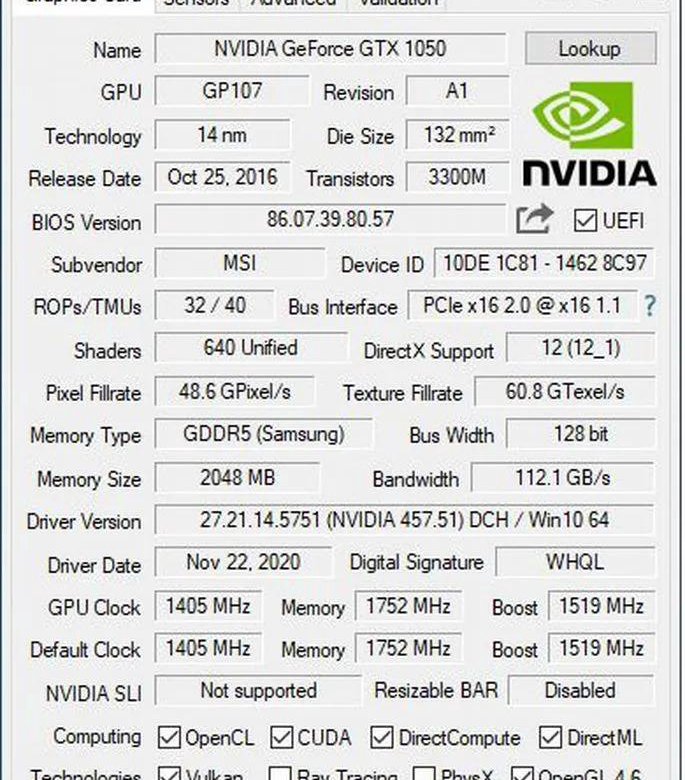

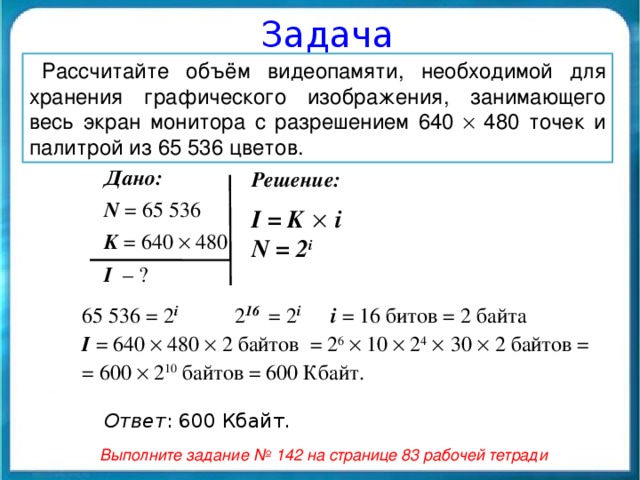

В видеопамяти располагаются данные, отсылаемые затем на экран как изображение. При работе в текстовом режиме в видеопамяти находятся коды и атрибуты символов, в графическом режиме — битовая карта. Часть видеопамяти, используемая под изображение для вывода на экран называется буфером (кадра) изображения (frame buffer). В текстовом режиме изображение состоит из символьной матрицы и область видеопамяти под него называется видеостраницей (video page). В обычном представлении процессор записывает данные в буфер изображения, после чего его считывает видеоконтроллер. Характеристиками видеопамяти являются её объём (memory size (МБайт, ГБайт)), тип (memory type), разрядность шины памяти (memory interface width, memory bus width (бит)), и тактовая частота (frequency, memory clock speed (МГц, ГГц)). Пропускная способность (memory bandwidth (Гбайт/с)) вычисляется произведением разрядности шины на тактовую частоту.

GDDR5 имеет несколько обозначений частоты: опорная, реальная и эффективная. На опорной частоте (core clock) работают транзисторы в чипах памяти. Реальная — частота шины (I/O bus clock) на которой работают буферы чипов памяти и буферы контроллера памяти, она в два раза больше опорной. Эффективная — по технологии DDR скорость передачи данных в два раза больше частоты шины. Пропускная способность определяется по формуле (частота x разрядность / 8) x множитель, где 8 переводит биты в байты, множитель 2 для GDDR3, 4 для GDDR5. Скорость памяти (memory speed) также обозначают в битах в секунду (Gbps, Гбит/с) показывая скорость одной линии (пина) в чипе. Например, на видеокарте 8 чипов памяти, в одном чипе GDDR5 32 линии на 8 Gbps каждая, тогда 8x32x8 даст общую пропускную способность в 2048 Гбит/с или 256 ГБайт/с.

Скорость памяти (memory speed) также обозначают в битах в секунду (Gbps, Гбит/с) показывая скорость одной линии (пина) в чипе. Например, на видеокарте 8 чипов памяти, в одном чипе GDDR5 32 линии на 8 Gbps каждая, тогда 8x32x8 даст общую пропускную способность в 2048 Гбит/с или 256 ГБайт/с.

Видеопамять используется для временного хранения, помимо непосредственно буфера изображения, и другие: текстуры, шейдеры, полигональные сетки, вершинные буферы, Z-буфер (удалённость элементов изображения в 3D-графике), и тому подобные данные графической подсистемы (за исключением, по большей части данных Video BIOS, внутренней памяти графического процессора и т. п.) и коды. При этом в видеопамяти может содержаться как непосредственно растровый образ изображения (экранный кадр), так и отдельные фрагменты как в растровой (текстуры), так и в векторной (многоугольники, в частности треугольники) формах. Программы для мониторинга, например RivaTuner и MSI AfterBurner, могут показывать объём используемой видеопамяти, Intel VTune отслеживает использование GPU пропускной способности памяти на чтение и запись. Программы-просмотрщики (VRAM Viewer) позволяют определять точное местоположение, просматривать и сохранять графические элементы из видеопамяти, например в эмуляторах.

Программы-просмотрщики (VRAM Viewer) позволяют определять точное местоположение, просматривать и сохранять графические элементы из видеопамяти, например в эмуляторах.

Чтобы уменьшить объём используемой VRAM, разработчики приложений могут выбрать как текстуры хранятся в VRAM. Кроме 32-битного описания пиксела в RGBA8, применяются 16- (RGB5_A1, RGBA4) и 8- битные (RGBA2) описания или сжатия (например, для S3TC есть аппаратная поддержка). Урезанные форматы файлов ухудшают качество, а при сжатии появляются артефакты. Спрайты плотно упаковываются в текстурный атлас (задача об упаковке в контейнеры). Несколько текстур представляется как одна текстура с палитрой. При использовании ресурсоёмких настроек или ошибках в играх иногда возникает ошибка «ran out of video memory». DirectDraw позволял разработчикам приложений прямой доступ к VRAM.

Процессор осуществляет запись по необходимости, а монитор обращается к ней непрерывно. При обновлении буфера в моменты, когда предыдущее изображение отрисовано на дисплее не до конца или при использовании видеопамяти больше чем физически доступно, появляется артефакт разрыва изображения (tearing, stuttering). Для более равномерного обновления буфера используют вертикальную синхронизацию.

Для более равномерного обновления буфера используют вертикальную синхронизацию.

Технологии

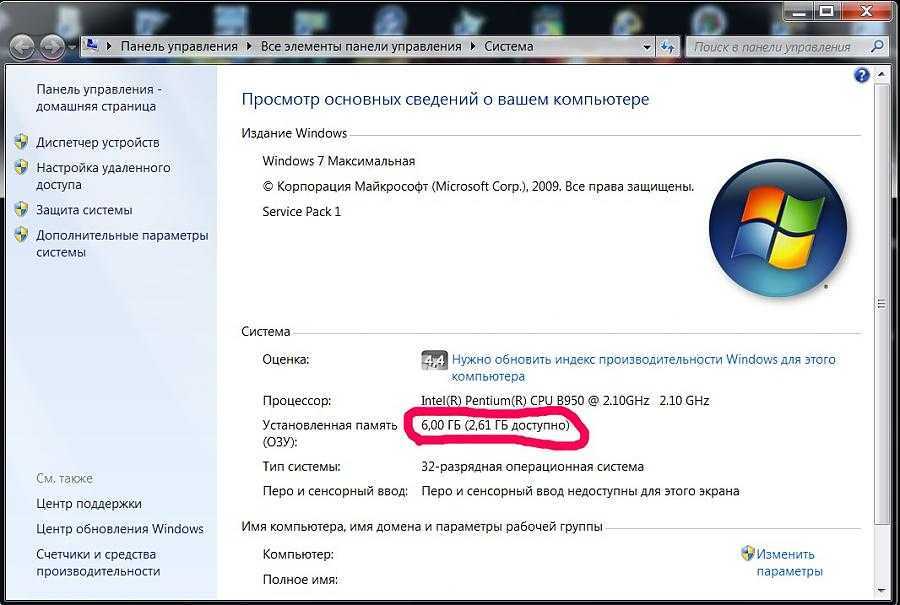

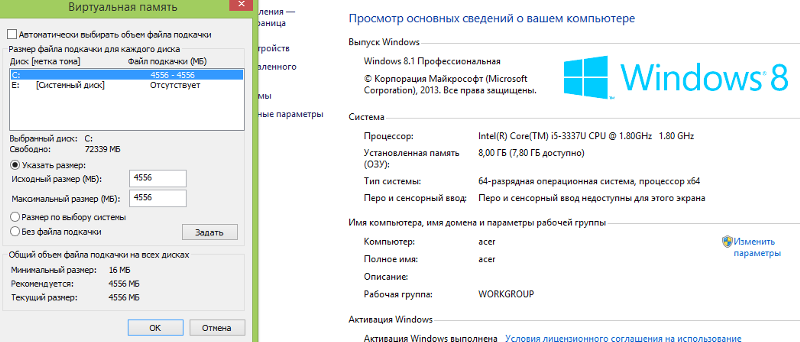

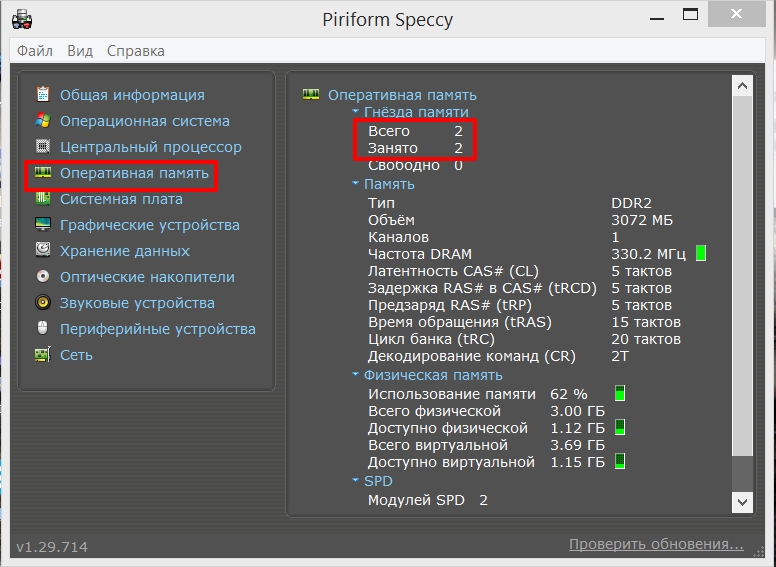

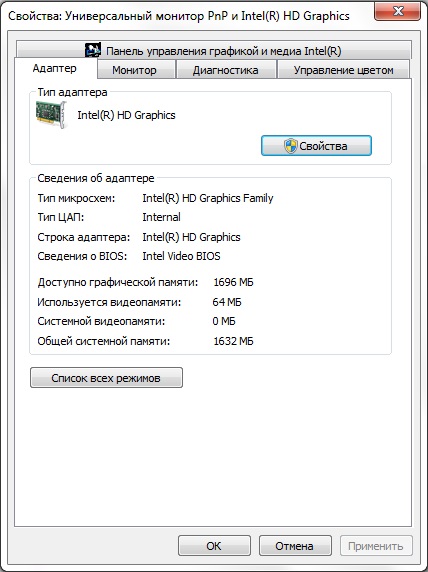

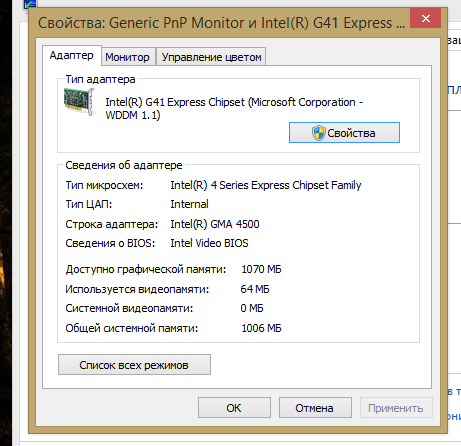

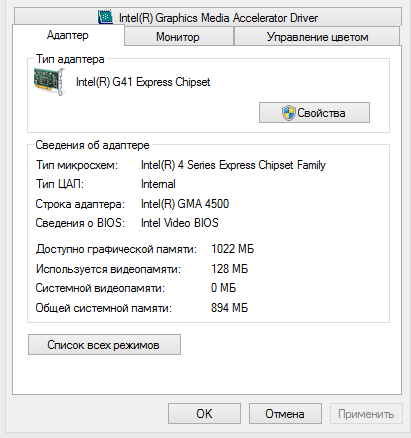

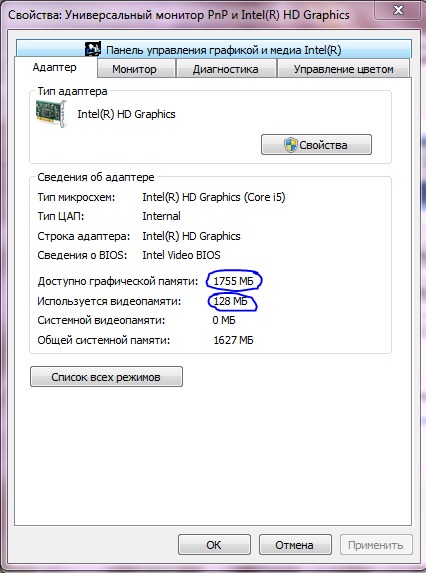

Унифицированная архитектура памяти en:Unified Memory Architecture (UMA) использует часть оперативной памяти как видеопамять. Под этим названием в разное время появлялись решения разных разработчиков. В технологии AGP-текстурирования графический процессор мог обращаться, помимо собственной памяти видеокарты, к файлам в оперативной памяти. В решениях Intel для встроенной графики объём видеопамяти выделяется динамически (Intel Dynamic video memory technology, DVMT) до половины системной памяти или меньше, а UEFI позволяет настраивать максимальный размер видеопамяти и апертуру. В решениях Nvidia и Apple графическая и системная память используют общее адресное пространство. В 2004 году ATI и Nvidia использовали HyperMemory и TurboCache для удешевления видеокарт.

Технологии Microsoft DirectStorage API и RTX IO позволяют загружать данные из NVMe SSD напрямую в VRAM без использования CPU и системной памяти.

В технологии объединения карт Nvidia SLI объём VRAM не удваивался, так как данные дублировались между VRAM двух карт. В начале, карта с большим объёмом подстраивалась под карту с меньшим и избыток объёма не использовался. С 100.xx версии драйверов в SLI объединялись только карты с совпадающим объёмом памяти.

Разгон

Разгон VRAM возможен через изменение параметров в BIOS видеокарты или используя специальные утилиты настройки видеокарты. Некоторые производители разрабатывают такие утилиты для собственных видеокарт, предоставляя возможность как ручного, так и автоматического разгона основанного на алгоритмах разработчика. Настройки VRAM позволяют кастомизировать тактовые частоты памяти и напряжения, а также тайминги для уменьшения задержек. В кастомизированных режимах работы ей требуется адекватный контроль и отвод тепла. В некоторых чипах GDDR встроены датчики температуры для защитных механизмов (downclocking). Micron для GDDR5, GDDR5X и GDDR6 указывает maximum junction temperature в 100°С.

История

В 1970-х в видеопамяти располагались данные текстового режима. После удешевления чипов памяти стало возможным хранить в видеопамяти графику в пикселях. В 80-90-х объём размещаемой на графических адаптерах VRAM быстро рос.

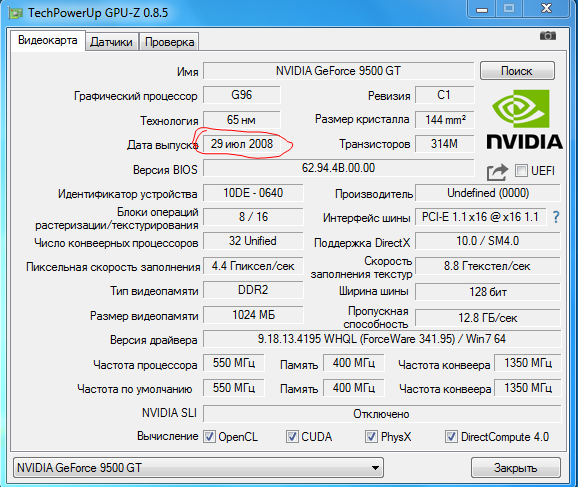

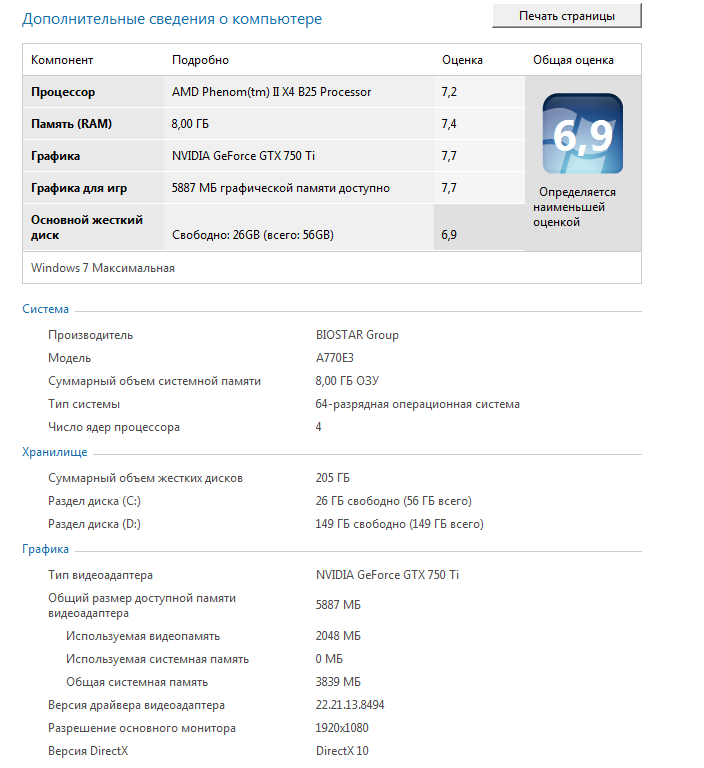

В 1981 году MDA имел 4 КБ VRAM и CGA — 16 КБ, Intel iSBX 275 в 1983 — 32 КБ, ATI Graphics Solution Rev 3 в 1986 — 64 КБ, VGA в 1986—256 КБ, NV1 в 1995 — 2 МБ, RIVA 128 в 1997 — 4 МБ, RIVA TNT в 1998 — 16 МБ, GeForce 256 в 1999 — 32 МБ. К концу 2000-х объём достиг 2 ГБ. В 2000 видеокарты в основном содержали 64 МБ (Radeon 7500 — 128 МБ), 2001—256 МБ, 2005—512 (GeForce 6600), 2007—1024 МБ (GeForce 8600 GT), 2008—2048 МБ (Radeon HD 4870). К 2015 объём достиг 8 ГБ. В 2011 — 3072 МБ (GeForce GT 440), 2012 — 4096 МБ (GeForce GTX 670), 2013 — 6144 МБ (GeForce GTX Titan), 2014 — 8192 МБ (Radeon R9 290X). Хотя в 2015 году вышла топовая модель видеокарты с 12 ГБ VRAM (GeForce Titan X), в 2018 — 24 ГБ (Titan RTX) и 32ГБ (Titan V CEO), к 2020 году в большинстве выпускаемых видеокарт предлагалось 2-8 ГБ VRAM.

В профессиональных вариантах видеокарт обычно добавляется больший объём видеопамяти. В 1980-х у IBM Professional Graphics Controller было 320 КБ из 40 чипов DRAM по 64 КБ. В 2020 у Quadro RTX 8000 было 48 ГБ, а с объединением карт через NVLink расширялось до 96 ГБ.

Типы видеопамяти: FPM DRAM (1990), VRAM, WRAM (1995), EDO DRAM (1995), SDRAM, MDRAM, SGRAM, DDR2 SDRAM, RDRAM, DRAM, CDRAM, Burst EDO, 3D RAM, Embedded RAM, FeRAM, DRDRAM, DDR SDRAM (DDR), ESDRAM, FCRAM, MRAM, GDDR (2000), GDDR2 (2003), GDDR3 (2004), GDDR4 (2006), GDDR5 (2008), GDDR6 (2017), HBM (2013), HBM2 (2016). Типы VRAM, WRAM — двухпортовая DRAM (двухпортовое видео-ОЗУ) позволяющая одновременно выполнять запись и чтение данных.

Для совместимости с 32-битными ОС объём VRAM, напрямую доступной CPU через PCI, был ограничен 256 Мбайтами. В 2008 году в стандарт PCI Express 3.0 была добавлена технология Resizable BAR, которая обеспечивает доступ ко всему объёму видеопамяти. В AMD технология называлась Smart Access Memory (SAM).

При изготовлении видеокарт уже достаточно давно используется память GDDR3. На смену ей пришла GDDR4, которая имеет более высокую пропускную способность, чем GDDR3; однако GDDR4 не получила широкого распространения вследствие плохого соотношения «Цена-производительность» и ограниченно использовалась лишь в некоторых видеокартах верхнего ценового сегмента (например Radeon X1950XTX, HD 2900 XT, HD3870). Далее появилась память GDDR5, которая по состоянию на 2012 год является наиболее массовой, GDDR3 используется в бюджетном сегменте. В 2018 году в топовых видеокартах устанавливается память типа HBM и HBM2, GDDR5X и GDDR6. По статистике Steam в 2018 году 2GB VRAM было у 32 % их игроков, 4GB — 19 % и 1GB — 17 %. В системных требованиях к играм часто указывают необходимый объём VRAM для разных уровней настроек.

Объём памяти большего количества современных видеокарт варьируется от 256 МБ (например, AMD Radeon HD 4350) до 48 ГБ (например, NVIDIA Quadro RTX 8000). Поскольку доступ к видеопамяти GPU и другими электронным компонентами должен обеспечивать желаемую высокую производительность всей графической подсистемы в целом, используются специализированные высокоскоростные типы памяти, такие, как SGRAM, двухпортовые (англ. dual-port) VRAM, WRAM, другие. Приблизительно с 2003 года видеопамять, как правило, базировалась на основе DDR технологии памяти SDRAM, с удвоенной эффективной частотой (передача данных синхронизируется не только по нарастающему фронту тактового сигнала, но и ниспадающему). И в дальнейшем DDR2, GDDR3, GDDR4, GDDR5 и на момент 2016 года GDDR5X. С выходом серии высокопроизводительных видеокарт AMD Fury совместно с уже устоявшейся на рынке памятью GDDR начала использоваться память нового типа HBM, предлагая значительно большую пропускную способность и упрощение самой платы видеокарты, за счёт отсутствия необходимости разводки и распайки чипов памяти. Пиковая скорость передачи данных (пропускная способность) памяти современных видеокарт достигает 480 ГБ/с для типа памяти GDDR5X (например, у NVIDIA TITAN X Pascal) и 672 ГБ/с для типа памяти GDDR6 (например, у TITAN RTX).

dual-port) VRAM, WRAM, другие. Приблизительно с 2003 года видеопамять, как правило, базировалась на основе DDR технологии памяти SDRAM, с удвоенной эффективной частотой (передача данных синхронизируется не только по нарастающему фронту тактового сигнала, но и ниспадающему). И в дальнейшем DDR2, GDDR3, GDDR4, GDDR5 и на момент 2016 года GDDR5X. С выходом серии высокопроизводительных видеокарт AMD Fury совместно с уже устоявшейся на рынке памятью GDDR начала использоваться память нового типа HBM, предлагая значительно большую пропускную способность и упрощение самой платы видеокарты, за счёт отсутствия необходимости разводки и распайки чипов памяти. Пиковая скорость передачи данных (пропускная способность) памяти современных видеокарт достигает 480 ГБ/с для типа памяти GDDR5X (например, у NVIDIA TITAN X Pascal) и 672 ГБ/с для типа памяти GDDR6 (например, у TITAN RTX).

Устройство

Видеопамять располагается на видеоадаптере или выделяется как часть от оперативной памяти. Как правило, чипы оперативной памяти современной видеокарты припаяны прямо к текстолиту печатной платы, в отличие от съёмных модулей системной памяти, которые вставляются в стандартизированные разъёмы ранних видеоадаптеров.

-

Отдельная видеокарта с собственной памятью. Данные копируются через шину PCI Express

-

Отдельная видеокарта с общей памятью en:Heterogeneous System Architecture. Через PCI Express передаются указатели делая возможным zero-copy.

-

Интегрированной видеокарте выделяется системная память

-

Интегрированная видеокарта с общей памятью (HSA)

Шина данных

Видеопамять отличается от «обычной» системной ОЗУ более жёсткими требованиями к ширине шины. Графическая шина данных — это магистраль, связывающая графический процессор и память видеокарт.

Полоса пропускания шина данных видеопамяти бывает:

- 32-битной.

- 64-битной.

- 128-битной.

- 192-битной. (нестандартная шина памяти)

- 256-битной.

- 320-битной. (нестандартная шина памяти)

- 384-битной. (нестандартная шина памяти)

- 448-битной.

(нестандартная шина памяти)

(нестандартная шина памяти) - 512-битной.

- 768-битной. (нестандартная шина памяти)

- 896-битной. (нестандартная шина памяти)

- 1024-битной.

- 2048-битной (только HBM-память)

- 3072-битной (только HBM2-память)

- 4096-битной (только HBM2-память)

Имеет значение соотношение количества памяти, её типа и ширины шины данных: 512 МБ DDR2, при ширине шины данных в 128 бит, будет работать медленнее и гораздо менее эффективно, чем 256 МБ GDDR3 при ширине шины в 128 бит и т. п. По понятным причинам, 256 МБ GDDR3 с шириной шины 256 бит лучше, чем 256 МБ GDDR3 с шириной шины в 128 бит и т. п.

Производство

Производители видеокарт не изготавливают VRAM самостоятельно, а закупают её. Некоторые известные производители VRAM — Samsung, Micron, Elpida Memory и Hynix. Разработчик видеокарты предусматривает в дизайне несколько конфигураций и оставляет тип, количество и размещение компонентов на плате на выбор производителей. На разных моделях одного референсного дизайна видеокарты может быть установлено разное количество чипов памяти предусмотренных типов, а также они могут быть расположены как на верхней, так и на нижней стороне платы.

Также стоит учитывать, что из-за относительно невысокой стоимости видеопамяти многие производители видеокарт устанавливают избыточное количество видеопамяти (4, 6 и 8 Гбайт) на слабые видеокарты с целью повышения их маркетинговой привлекательности. На видеокартах чипы памяти обычно располагают вокруг видеопроцессора, чтобы отводить тепло от них общим с процессором кулером.

Новый стандарт высокоскоростной памяти High Bandwidth Memory

Главная особенность будущего графического процессора компании AMD

Содержание

- Введение

- Проблемы существующих типов графической памяти

- Устройство и специфика HBM

- Преимущества и недостатки нового стандарта памяти

- Заключение

Введение

В скором времени в мире стандартов оперативной памяти грозят произойти несколько важных изменений, и первопроходцами должны стать производители графических процессоров, как самые заинтересованные в получении максимальной пропускной способности и энергоэффективности. У обоих основных производителей GPU есть планы по внедрению нового стандарта скоростной памяти High Bandwidth Memory (HBM), хотя существуют и другие варианты: Wide I/O (Samsung) и HMC, Hybrid Memory Cube (Intel и Micron).

У обоих основных производителей GPU есть планы по внедрению нового стандарта скоростной памяти High Bandwidth Memory (HBM), хотя существуют и другие варианты: Wide I/O (Samsung) и HMC, Hybrid Memory Cube (Intel и Micron).

Для чего вообще вдруг понадобились новые типы памяти, почему не обойтись использованием GDDR5 в видеокартах и DDR4 в других системах? Оба указанных типа памяти, универсальной и графической, являются всего лишь эволюционным развитием давно известных стандартов, и хотя они имеют улучшенные характеристики по производительности и энергопотреблению по сравнению с DDR3 и GDDR3/GDDR4, но улучшения эти не столь значительны, как многим хотелось бы.

Основам ныне применяемых стандартов DRAM уже не один десяток лет, и их улучшение позволило повысить пропускную способность далеко не настолько, насколько выросла производительность CPU и GPU за это время. Двадцать лет улучшения стандартов позволили поднять пропускную способность памяти (ПСП) всего лишь примерно в 50 раз, в то время как скорость вычислений за это время выросла много больше. Особенно это касается графических процессоров, скачок в производительности которых за это время произошел весьма существенный. И индустрии требуются новые типы памяти, которые дадут совершенно иные возможности, вроде Wide I/O, HMC и HBM.

Особенно это касается графических процессоров, скачок в производительности которых за это время произошел весьма существенный. И индустрии требуются новые типы памяти, которые дадут совершенно иные возможности, вроде Wide I/O, HMC и HBM.

Все эти стандарты основываются на так называемой stacked DRAM — размещении чипов памяти слоями, с одновременным доступом к разным микросхемам, что расширяет шину памяти, значительно повышая пропускную способность и немного снижая задержки. Описание разницы между указанными стандартами выходит за рамки данной статьи, но все указанные стандарты имеют множество схожих черт, хотя и с некоторыми особенностями.

Стандарт Hybrid Memory Cube, предлагаемый Intel и Micron, можно назвать наиболее универсальным, он должен позволить получить ПСП до 480 ГБ/с при несколько бо́льших энергопотреблении и себестоимости по сравнению с Wide I/O 2. Появление продукции с использованием HMC ожидается в следующем году. На данный момент стандарт HMC не является стандартом JEDEC, но в консорциум входят такие крупные компании, как Samsung, Micron, Microsoft, Altera, ARM, Intel, HP, Xilinx, SK Hynix и другие, так что поддержка со стороны индустрии у стандарта достаточная. Однако среди поддерживающих HMC нет (пока?) компаний AMD и Nvidia, выпускающих графические процессоры — они выбрали для себя конкурирующий (условно) стандарт компании Hynix — High Bandwidth Memory.

Однако среди поддерживающих HMC нет (пока?) компаний AMD и Nvidia, выпускающих графические процессоры — они выбрали для себя конкурирующий (условно) стандарт компании Hynix — High Bandwidth Memory.

Стандарт HBM не настолько универсальный, как HMC, это специализированная версия Wide I/O 2, которая лучше всего подходит именно для графических процессоров, хотя может применяться и в будущих гибридных процессорах APU компании AMD, например. Хотя компании AMD и Nvidia уже анонсировали применение HBM в будущих поколениях GPU, Nvidia ожидает выхода своего Pascal с поддержкой этой памяти лишь в 2016-м, тогда как AMD планирует выпуск первого графического процессора, оснащенного HBM-памятью, уже в середине текущего года.

Что касается сравнения со стандартами Wide I/O и HMC, то HBM — это среднее решение по цене и производительности, специализированное для применения в связке с высокопроизводительными GPU, которое дороже в производстве, чем Wide I/O, но дешевле HMC. Кроме того, очень похоже, что HBM станет первой из перечисленных технологий stacked DRAM, которая появится на пользовательском рынке в виде графических решений. Применение же технологии Micron HMC пока что будет ограничено серверами и суперкомпьютерами, вроде семейства Knights Landing (Xeon Phi) Intel.

Применение же технологии Micron HMC пока что будет ограничено серверами и суперкомпьютерами, вроде семейства Knights Landing (Xeon Phi) Intel.

Новые стандарты полностью изменят рынок памяти, предлагая значительно бо́льшую ПСП и серьезное улучшение энергоэффективности. Кроме этого, немного снизятся и задержки доступа, что не так важно для применения в графических задачах, зато будет полезно в гибридных APU. Да и Intel вполне может начать применять stacked-память в своих будущих решениях, предназначенных для рынка настольных ПК, когда это станет экономически целесообразно. Такие типы памяти, как HMC и HBM, откроют гибридным процессорам совершенно новые возможности, и производительность встроенного графического ядра значительно вырастет.

Еще в 2011 году компании AMD и Hynix анонсировали совместные планы по разработке и внедрению нового стандарта памяти — High Bandwidth Memory (HBM). Новый тип памяти должен был стать огромным шагом вперед по сравнению с применяющейся до сих пор GDDR-памятью, и среди главных преимуществ HBM значились серьезное увеличение пропускной способности и увеличение энергетической эффективности (снижение потребления вместе с ростом производительности).

Компания AMD, как и компания ATI в годы своей жизни, в последние несколько лет была лидером по освоению новых типов графической памяти. Хотя продукты с поддержкой GDDR2 и GDDR3 первыми выпустили не они, но именно эта компания первой оснастила свои решения видеопамятью последних двух существующих стандартов (GDDR4 и GDDR5). Соответственно, в 2011 году в партнерстве с Hynix они решили продолжить свои инициативы по приоритетной разработке и внедрению новых стандартов видеопамяти для будущих GPU. И вот, после четырех лет разработки подошло то самое время, когда эти компании наконец-то готовы предложить рынку графический процессор, оснащенный совершенно новым типом графической памяти.

В своем отчете с мероприятия AMD под названием 2015 Financial Analyst Day мы уже рассказывали читателям о том, что компания анонсировала первое в индустрии применение HBM-памяти в своем следующем графическом процессоре, который должен выйти еще в этом квартале (то есть до конца июня).

В то время AMD еще не была готова поведать технические подробности применения HBM-памяти, да и сейчас многие технические характеристики основанного на HBM графического чипа остаются неизвестными, но заинтересованным представителям технической IT-прессы уже рассказали определенные детали. Видимо, в AMD захотели превратить свое первое в индустрии применение HBM-памяти в отдельное событие, заранее раскрыв некоторые карты. Давайте посмотрим, что же мы узнали.

Видимо, в AMD захотели превратить свое первое в индустрии применение HBM-памяти в отдельное событие, заранее раскрыв некоторые карты. Давайте посмотрим, что же мы узнали.

Проблемы существующих типов графической памяти

За четыре поколения GDDR-памяти ее разработчики продолжали увеличивать тактовые частоты, на которой она способна работать, для увеличения пропускной способности. В итоге родилась GDDR5-память с эффективной рабочей частотой более чем 7 ГГц. Но первый графический ускоритель, использующий память GDDR5 (ATI Radeon HD 4870, если кто забыл), был выпущен еще в июне аж 2008 года! С тех пор прошло уже почти семь лет — больше, чем продержались другие типы графической памяти.

А расти то уже больше особо и некуда — из возможностей GDDR выжато почти все. В стандарте GDDR5 нынешний тип памяти достиг своего предела, и хотя небольшие возможности для роста ПСП еще есть, но они требуют слишком больших усилий и не изменят ситуацию кардинально. Но самое главное — вопрос высокого потребления не решился до сих пор. А ведь энергоэффективность — главный параметр для любого современного чипа. Даже текущие поколения GDDR5-памяти уже потребляют слишком много энергии из-за сложных механизмов тактования и работы на очень высокой частоте, а любые улучшения производительности GDDR5 связаны с дальнейшим повышением частоты и сложности чипов, а значит, и энергопотребления.

А ведь энергоэффективность — главный параметр для любого современного чипа. Даже текущие поколения GDDR5-памяти уже потребляют слишком много энергии из-за сложных механизмов тактования и работы на очень высокой частоте, а любые улучшения производительности GDDR5 связаны с дальнейшим повышением частоты и сложности чипов, а значит, и энергопотребления.

Потребление энергии исключительно чипами GDDR5-памяти в современных топовых видеокартах по оценке компании AMD уже сейчас составляет около 15-20% — то есть из 250 Вт потребления видеокарты Radeon R9 290X где-то до 40-50 Вт тратится на обеспечение работы чипов памяти. Такие данные получились даже с учетом того, что в AMD намеренно выбрали более широкую 512-битную шину памяти в GPU и использовали не слишком быструю GDDR5-память, работающую на частоте 5 ГГц — как раз для того, чтобы снизить потребление энергии видеопамятью.

А если представить точно такой же графический процессор, но с GDDR5-памятью, работающей уже на частоте в 7 ГГц? Видеопамять в таком случае будет потреблять еще больше энергии, что лишь усугубит проблему энергоэффективности и оставит GPU без необходимой доли энергии. Компания AMD показывает диаграмму изменения потребления питания GPU и RAM — если ничего не менять, то скоро они сравняются по пожиранию энергии, что приведет к снижению общей производительности.

Компания AMD показывает диаграмму изменения потребления питания GPU и RAM — если ничего не менять, то скоро они сравняются по пожиранию энергии, что приведет к снижению общей производительности.

Мы уже не раз говорили о том, что в настоящее время вопрос энергопотребления стал важнейшим из параметров для любой электроники, так как он напрямую связан с энергоэффективностью и производительностью, и его важность лишь продолжит усиливаться в будущем. Возьмем мобильные устройства, часто работающие в автономном режиме — время их работы полностью зависит от энергоэффективности внутренней начинки, так как объем батарей увеличивать уже просто некуда, ведь на этот параметр накладываются физические ограничения.

Но не только популярные мобильные устройства нуждаются в энергоэффективных решениях. Высокое потребление энергии ограничивает производительность и настольных CPU и GPU, ведь пределы потребления энергии ими неизменны уже несколько лет, расти может лишь производительность (а вместе с ней и энергоэффективность). И основной тренд на рынке сейчас такой, что ему требуются все более энергоэффективные устройства и чипы.

И основной тренд на рынке сейчас такой, что ему требуются все более энергоэффективные устройства и чипы.

И это еще не все проблемы нынешнего стандарта памяти GDDR5. Также эти чипы занимают слишком много места на плате и требуют применения нескольких каналов памяти, что усложняет сам графический процессор. Особенно если говорить о топовых GPU с 384-битной или даже 512-битной шиной памяти. Не то чтобы сам по себе размер видеокарт имел слишком большое значение для игровых ПК, но ведь в последнее время появляется довольно много компактных корпусов, применять в которых нынешние видеокарты весьма сложно, а минимизация размера платы в этом как раз и поможет.

Теоретически, можно было бы встроить DRAM прямо в кристалл видеочипа, но это не будет эффективным решением, так как параметры технологических процессов для производства кристаллов GPU и RAM нужны совсем разные, и интеграция на одном чипе не будет оправданной с точки зрения производства.

То есть такой вариант тоже не подходит, но и с GDDR5 продолжать прогрессировать вскоре будет невозможно из-за снижения энергоэффективности этого типа памяти. Именно поэтому инженеры сразу нескольких компаний несколько лет назад и начали разработку новых поколений стандартов памяти со сверхширокой шиной, в том числе и HBM.

Именно поэтому инженеры сразу нескольких компаний несколько лет назад и начали разработку новых поколений стандартов памяти со сверхширокой шиной, в том числе и HBM.

Устройство и специфика HBM

Исходя из сложностей и проблем развития и совершенствования GDDR5-памяти и аналогичных технологий памяти, разработка новых стандартов с широкой шиной в последние годы привела к появлению «широких», но медленных интерфейсов. Это можно представить как переход от быстрой последовательной работы микросхем памяти к медленным параллельным интерфейсам. Если в прошлые годы было проще увеличить тактовую частоту, чем расширить шину памяти, то теперь мы уперлись в скорость передачи данных с каждого чипа и пришло время распараллеливать сам интерфейс. Пусть этот путь и связан с определенными сложностями, но когда-то к нему все равно пришлось бы переходить.

В стандарте HBM и аналогичных ему, вместо массива очень быстрых чипов памяти (7 ГГц и выше), соединенных с графическим процессором по сравнительно узкой шине от 128 до 512 бит, применяются очень медленные чипы памяти (порядка 1 ГГц эффективной частоты), но ширина шины памяти при этом получается шире в несколько раз. Как и в случае с GDDR5, ширина шины для различных GPU будет разной и она зависит как от поколения стандарта HBM (первого или второго на данный момент), так и конкретного воплощения.

Как и в случае с GDDR5, ширина шины для различных GPU будет разной и она зависит как от поколения стандарта HBM (первого или второго на данный момент), так и конкретного воплощения.

Компания AMD говорит о применении четырех стеков (stacks, стопок или пачек) чипов памяти, каждая из которых состоит из четырех микросхем и дает 1024-битный интерфейс памяти. То есть в итоге на GPU получаются просто широченная по меркам GDDR5-памяти шина в 4096 бит. Естественно, что при этом чипам памяти не обязательно работать на таких высоких частотах, как в случае GDDR5 — даже низких частот будет достаточно, чтобы по полосе пропускания памяти (ПСП) заметно обойти привычные доселе интерфейсы.

Конечно, интересующимся технической стороной дела хотелось бы узнать не только цифры ПСП, но и то, каким образом они достигаются. Сама по себе идея сверхширокой шины памяти лежит на поверхности, но одно дело теория, а совсем другое — практика. Именно сложности с практической реализацией присоединения очень широкой шины и не давала воплотить все это ранее.

4096-битная шина памяти требует значительно большее количество соединений, по сравнению с привычной GDDR5, и все они должны поместиться физически, чтобы такая шина работала. Именно эти параллельные соединения и являются главной проблемой в воплощении GPU с HBM-памятью, и для успешного решения задач по их размещению в новом типе памяти применяется несколько новых технологий, о которых мы сейчас и расскажем.

Самым важным вопросом, который встал перед инженерами, является эффективная разводка 4096-битной шины памяти. Ведь даже самые последние технологии производства чипов имеют свои ограничения, и графические процессоры никогда не переходили предел в 512 бит, даже в самых последних топовых графических чипах вроде Hawaii. Организовать еще более широкую шину памяти на больших GPU теоретически можно, но решение этой очень сложной задачи будут ограничивать физические возможности по размещению такого количества соединений и на печатной плате и в самом чипе, не говоря уже о необходимом количестве контактов на корпусах типа BGA.

Решением первой части этой задачи стала разработка специального слоя, который способен вместить соединения большой плотности — кремниевой подложки (interposer). Этот слой похож на обычный кремниевый кристалл, в котором вместо некоей внутренней логики размещены исключительно металлические слои для передачи сигналов и питания между различными компонентами — этакий переходник. При производстве interposer используются возможности современных литографических процессов, позволяющих разместить очень тонкие проводники, которые практически невозможно вместить на традиционных печатных платах.

Использование такого слоя-переходника решает часть фундаментальных проблем по размещению широкой шины памяти, а также дает и другие преимущества. Так, вместе с решением проблемы маршрутизации проводников, эта кремниевая подложка позволяет разместить чипы памяти очень близко к GPU, но не прямо на кристалле, как применяется в случаях мобильных систем-на-чипе, например. Ведь подобное решение (package on package, или PoP) попросту невозможно для выделяющих значительное количество тепла графических процессоров.

А если поместить микросхемы памяти близко к графическому чипу, то и длинных соединений между ними не требуется, что упрощает конструкцию и предъявляет менее жесткие требования по питанию. Помещение чипов памяти вместе с основной логикой также выигрывает в повышении степени интеграции — большее количество функциональной логики можно собрать в одной упаковке, что уменьшает количество необходимой внешней обвязки. А достижение высокой степени интеграции — давний тренд в индустрии. Все постепенно интегрировалось в кристаллы: сначала кэш-память и FPU, затем чипсетная логика и графические ядра, а теперь вот и память перебирается поближе к вычислительным ядрам.

Конечно, у решения с промежуточным слоем интерпозера есть и свои недостатки — это усложнение конструкции и повышение себестоимости производства. Естественно, что никто из AMD пока что не говорит о стоимости производства первых чипов с HBM, но очевидно, что добавление дополнительного слоя, а также его соединение и тестирование всего продукта, включающего сложнейшую логику, может лишь увеличить его себестоимость, особенно в самом начале его производства. И особенно — по сравнению с давно отработанными технологиями производства традиционных печатных плат и чипов без кучи слоев, соединенных друг с другом.

И особенно — по сравнению с давно отработанными технологиями производства традиционных печатных плат и чипов без кучи слоев, соединенных друг с другом.

Ну хотя бы сам по себе слой интерпозера не столь сложен, как сам графический процессор и он не требует столь же сложного и современного производственного процесса. Отработанного годами и весьма недорогого по современным меркам техпроцесса 65 нм здесь более чем достаточно. И все-таки интерпозер явно добавляет некоторую сумму к себестоимости всего продукта с поддержкой HBM, так что абсолютно логичным выглядит первое применение этого типа памяти пока что лишь исключительно в топовых GPU. Про менее дорогие видеокарты и уж тем более гибридные процессоры APU можно говорить пока что лишь теоретически и с большой осторожностью.

Рассматривая весь «бутерброд» в разрезе, можно увидеть, что интерпозер становится новым слоем между традиционной упаковкой и чипами DRAM с дополнительной управляющей логикой, смонтированными прямо на интерпозере. Для связи чипов памяти и логики с интерпозером используются специальные соединения типа microbump и TSV (through-silicon vias), далее интерпозер соединяется с основным кристаллом, а тот уже привычно соединен с печатной платой контактами BGA.

Для связи чипов памяти и логики с интерпозером используются специальные соединения типа microbump и TSV (through-silicon vias), далее интерпозер соединяется с основным кристаллом, а тот уже привычно соединен с печатной платой контактами BGA.

Само по себе присоединение чипа с HBM-памятью к печатной плате несколько упрощается, так как в данном случае на PCB не будет никаких соединительных линий к микросхемам памяти, останутся только линии для передачи данных (по шине PCI Express и т. п.), а также для питания графического процессора и микросхем памяти. Часть этих сложностей переходит на слой интерпозера, поэтому его тестирование при производстве становится одной из самых важных задач.

Еще один важный технологический момент в присоединении чипов HBM-памяти друг к другу заключается в создании соединений типа through-silicon vias (TSV). Если интерпозер решает задачу маршрутизации широкой ширины памяти для GPU, то этот тип соединений позволяет соединить стопку микросхем памяти в единый 1024-битный стек. Причины для такого объединения нескольких чипов просты — облегчение производства и снижение количества отдельных устройств в системе. Главная сложность в том, что традиционные методы соединений, какие используются в упаковке PoP, не способны обеспечить достаточную плотность соединений, их должно быть очень много и они очень маленькие.

Причины для такого объединения нескольких чипов просты — облегчение производства и снижение количества отдельных устройств в системе. Главная сложность в том, что традиционные методы соединений, какие используются в упаковке PoP, не способны обеспечить достаточную плотность соединений, их должно быть очень много и они очень маленькие.

Поэтому проблема объединения стопки чипов DRAM была решена при помощи TSV-соединений. Обычные типы соединений позволяют соединить два слоя вместе, а TSV расширяет эти возможности, соединяя и дальнейшие кремниевые слои. С точки зрения производственного процесса, соединения типа TSV сложнее в производстве и объединение чипов DRAM в стеки является непростой технологической задачей. К стопке чипов памяти снизу присоединено еще и логическое ядро, которое отвечает за работу всех чипов DRAM в стеке и управляет шиной HBM между стеком и GPU.

Главным ограничителем для дальнейшего роста производительности сейчас являются возможности по изготовлению слоя интерпозера — в нем нужно сделать много очень маленьких соединений для нескольких слоев памяти. Именно поэтому количество слоев пока что ограничено четырьмя, а размещения восьми слоев придется немного подождать — в HBM второго поколения уже будет восемь слоев (и вдвое больше ПСП при прочих равных условиях, соответственно). В остальном HBM2 будет мало отличаться от HBM1. Разве что еще ожидается поддержка коррекции ошибок ECC, важная для применения в профессиональных решениях.

Именно поэтому количество слоев пока что ограничено четырьмя, а размещения восьми слоев придется немного подождать — в HBM второго поколения уже будет восемь слоев (и вдвое больше ПСП при прочих равных условиях, соответственно). В остальном HBM2 будет мало отличаться от HBM1. Разве что еще ожидается поддержка коррекции ошибок ECC, важная для применения в профессиональных решениях.

Преимущества и недостатки нового стандарта памяти

После рассмотрения технических вопросов о том, как именно устроена HBM-память, переходим к характеристикам ее производительности и другим преимуществам HBM. Хотя сходу может показаться, что тут все просто, но кроме банального прироста в полосе пропускания памяти, более низкое потребление и физически меньший размер дают дополнительные плюсы перед GDDR5-памятью.

Но сначала поговорим о чистой производительности. Что даст применение HBM? Ответ не так прост и зависит от того, сколько стеков (стопок) чипов памяти установлено в данном продукте, от количества чипов памяти в стеке и от частоты работы этих чипов. Тут важно отметить разницу между двумя поколениями HBM-памяти. Первое поколение, которое и ожидается к применению в следующем топовом GPU AMD, позволяет использовать 1024-битные стеки из четырех чипов, работающих с частотой до 500 МГц, которая соответствует эффективной частоте в 1 ГГц для DDR-памяти. То есть каждый стек способен обеспечить до 128 ГБ/с полосы пропускания видеопамяти.

Тут важно отметить разницу между двумя поколениями HBM-памяти. Первое поколение, которое и ожидается к применению в следующем топовом GPU AMD, позволяет использовать 1024-битные стеки из четырех чипов, работающих с частотой до 500 МГц, которая соответствует эффективной частоте в 1 ГГц для DDR-памяти. То есть каждый стек способен обеспечить до 128 ГБ/с полосы пропускания видеопамяти.

В теории, HBM позволяет использовать и восемь стеков на один чип, когда каждый из стеков включает 1 ГБ памяти. Но AMD приводит пример, в котором используется четыре стека, что дает нам итоговую пропускную способность в 512 ГБ/с. Конечно, это больше, чем 320 ГБ/с у Radeon R9 290X и 336 ГБ/с у лучшей карты конкурента Geforce GTX Titan X, но обеспечивает лишь до 60% прироста в ПСП — не слишком много для абсолютно нового типа памяти с такой широкой шиной, ведь чисто теоретически можно предположить появление GPU с 512-битной шиной и применением очень быстрой GDDR5-памяти, которая по ПСП не уступит первому варианту HBM-памяти.

Любопытно, что представитель AMD уверил нас, что и задержки доступа к памяти в случае с HBM получаются чуть ниже — на 15-20% по сравнению с GDDR5. Это не так уж важно для графических задач, но очень важно для CPU и некоторых вычислительных задач на GPU. Кроме того, в будущих продуктах HBM-память можно будет применять в том числе и в качестве кэш-памяти последнего уровня, например, но это скорее вопрос к разработчикам CPU, чем GPU.

Кроме повышения ПСП и небольшого снижения задержек, применение HBM обеспечивает и снижение потребления энергии всей подсистемой памяти. Мы уже писали выше о том, что в текущем топовом решении Radeon R9 290X до 15-20% из 250 Вт общего потребления энергии, расходуется на питание чипов GDDR5. Если посчитать, то это будет до 37,5-50 Вт в абсолютных цифрах. Хотя из следующей диаграммы AMD следует, что GDDR5 обеспечивает 10,66 ГБ/с ПСП на 1 Вт, то есть по этим расчетам потребление GDDR5-памяти получается несколько ниже — 30 Вт. HBM же память дает более 35 ГБ/с на ватт, то есть обеспечивает более чем втрое лучшую энергоэффективность, по сравнению с GDDR5.

Доля памяти в общем энергопотреблении видеокарт пока что может быть и не слишком велика, но она постоянно растет, и чем дальше — тем будет только хуже. Ведь рост потребления энергии чипами GDDR5 в зависимости от ПСП нелинейный, потребление энергии растет быстрее, чем тактовая частота и обеспечиваемая ПСП, и в будущем такая ситуация начала бы ограничивать общую производительность видеокарт.

Преимущество в энергоэффективности позволяет или улучшить производительность или сэкономить энергию. Последнее важно скорее для мобильных решений, а для ожидаемого топового GPU можно повысить ПСП при отсутствии роста потребления энергии. Так что вряд ли энергопотребление снизится настолько уж сильно. Если взять предполагаемое значение итогового ПСП в 512 ГБ/с при четырех стеках HBM-памяти, то такие чипы будут потреблять около 15 Вт против 30 Вт у 320 ГБ/с GDDR5 в случае Radeon R9 290X.

Это преимущество в 15 или даже 20-25 Вт (с учетом разницы в ПСП) можно потратить на разные вещи, но для топового GPU вероятнее именно увеличение производительности. Ведь та же технология управления питанием PowerTune ограничивает общее потребление видеокартой, и большая доля питания, выделенная для GPU, позволит компании AMD повысить тактовые частоты для следующего топового графического процессора с HBM. Увы, конкретных цифр у нас пока что нет, ни итоговой ПСП конечного продукта, ни тактовых частот, ни цифр энергопотребления. Так что мы можем только гадать, что в итоге получится у AMD.

Ведь та же технология управления питанием PowerTune ограничивает общее потребление видеокартой, и большая доля питания, выделенная для GPU, позволит компании AMD повысить тактовые частоты для следующего топового графического процессора с HBM. Увы, конкретных цифр у нас пока что нет, ни итоговой ПСП конечного продукта, ни тактовых частот, ни цифр энергопотребления. Так что мы можем только гадать, что в итоге получится у AMD.

В любом случае, все графические процессоры в большей или меньшей степени страдают от недостатка в пропускной способности памяти — во многих случаях это негативно влияет на общую производительность 3D-рендеринга. И у нас нет никаких сомнений в том, что резкое увеличение ПСП будет благом, и применение HBM лишь улучшит итоговую производительность.

Но тут есть одна оговорка — даже имея преимущество по ПСП, существующие решения компании AMD зачастую или не быстрее соперничающих видеокарт Nvidia, или даже несколько медленнее их. Так что мы бы хотели предостеречь от слишком больших ожиданий от внедрения HBM-памяти, по крайней мере в игровых задачах. Похоже, что у соперника AMD лучше работают технологии по сжатию информации во фреймбуфере (применяются методы без потерь, разумеется).

Похоже, что у соперника AMD лучше работают технологии по сжатию информации во фреймбуфере (применяются методы без потерь, разумеется).

Но если новый GPU AMD будет основан на архитектуре GCN 1.2 или более новой, то есть шанс к улучшению ситуации, так как именно в этой версии архитектуры были внедрены новые методы сжатия данных, что должно выправить ситуацию. Так что ожидаемый топовый графический процессор AMD получит высокую ПСП физически, да еще и улучшенную эффективность ее использования, что должно дать некоторое преимущество в условиях ограничения общей скорости рендеринга полосой пропускания — например, в высоких разрешениях.

С точки зрения проектирования самого графического процессора, с применением HBM можно сэкономить и площадь кристалла GPU, которую занимают контроллеры памяти — так как протоколы памяти сильно упрощены, по сравнению с GDDR5. Отсюда же следует некоторая экономия энергии, потребляемой этими контроллерами памяти — есть преимущество по энергоэффективности в том числе и со стороны GPU — видеочип с HBM-памятью также потребляет меньше энергии при прочих равных, а не только сами чипы памяти.

Еще одним преимуществом памяти стандарта HBM, отмечаемым компанией AMD в своих материалах, является компактность в смысле физических размеров всего устройства — GPU вместе с чипами DRAM занимает очень мало места, по сравнению с привычными для нас форм-факторами с большой печатной платой, отдельным GPU и микросхемами памяти, размещенными на ней на некотором отдалении. Естественно, что замена чипов GDDR5-памяти на маленькие HBM-стеки даст итоговое уменьшение размеров всей видеоплаты.

Насколько велика разница в размерах, и важна ли она? Как видно по иллюстрации выше, каждый гигабайт GDDR5-памяти, состоящий из четырех двухгигабитных микросхем, занимает до 672 мм², а такое же количество HBM-памяти в виде HBM-стеке займет лишь 35 мм² — это почти в 20 раз меньше! Даже если пересчитать цифры с применением четырехгигабитных микросхем, то разница по занимаемой площади останется почти на порядок.

Даже если брать площадь, занимаемую на PCB всеми микросхемами, то по расчетам AMD получается, что упаковка GPU с HBM-памятью займет порядка 4900 мм² против 9900 мм² у нынешней видеокарты Radeon R9 290X. Эту дополнительную экономию места можно также использовать в разных целях, особенно учитывая еще и то, что стеки HBM-памяти не нуждаются в отдельной сложной подсистеме питания, поэтому на практике разница будет еще больше.

Эту дополнительную экономию места можно также использовать в разных целях, особенно учитывая еще и то, что стеки HBM-памяти не нуждаются в отдельной сложной подсистеме питания, поэтому на практике разница будет еще больше.

К слову, конкурент AMD также уже показывал картинки аналогичного решения и рассказывал об экономии места и возможном появлении новых форм-факторов. Хотя экстремальным игровым энтузиастам на ПК не особенно нужно уменьшение физических размеров видеокарт, но для остальных людей уменьшение размеров одного из основных компонентов системы будет только на пользу — можно будет в маленький корпус засунуть мощный GPU с быстрой HBM-памятью. Главное — не забыть хорошо охладить такую систему.

И тут также есть некоторые вопросы, так как в случае подобного решения чипы DRAM и сам GPU будут в одной упаковке, которая наверняка будет накрыта единой теплоотводящей крышкой, покрывающей и HBM-стеки и ядро GPU. Будет ли в таком случае обеспечиваться достаточно эффективное охлаждение для всей системы и не повлияет ли на работу чипов памяти соседство с крайне горячим ядром графического процессора? Остается лишь ждать появления финального продукта AMD.

В этом же контексте интересно утверждение AMD о том, что разгон HBM-памяти будет осуществить даже проще, чем GDDR5, из-за сравнительно простой системы тактирования и меньшего напряжения питания. При этом, разгон HBM принесет большую пользу, так как даже маленькое увеличение частоты работы чипов памяти выльется в серьезное повышение ПСП из-за очень широкой шины памяти. Но это мы тоже сможем проверить лишь когда выйдет соответствующая видеокарта с новым GPU.

Но неужели у HBM-памяти и первого GPU с ее применением нет недостатков? На наш взгляд, главным минусом предполагаемой конфигурации из четырех стеков HBM-памяти станет общий объем видеопамяти — ведь четыре стека по 1 ГБ дают лишь 4 ГБ в целом. Мы до сих пор не уверены в том, что будущий продукт AMD будет включать лишь четыре стека HBM-памяти, но вероятность этого весьма велика. И запуск нового топового графического процессора, имеющего доступ лишь к 4 ГБ памяти, пусть и очень быстрой, потенциально может стать довольно большой проблемой, ведь решения конкурента будут иметь больше видеопамяти, хотя и медленной GDDR5, но с весьма эффективным ее использованием.

Причина этого ограничения в 4 ГБ во многом заключается в том, что в будущем топовом GPU AMD они решили применить HBM-память первого поколения, имеющую некоторые ограничения. Главным из которых является лишь четыре микросхемы DRAM на стек, что дает объем 1 ГБ на стек. И, судя по всему, текущий дизайн AMD позволяет разместить вокруг GPU всего лишь четыре стека, что и ограничивает общий объем четырьмя гигабайтами.

Возможно, дело в том, что размер вскоре выходящего GPU слишком мал для того, чтобы разместить на нем восемь стеков HBM, или дело в снижении себестоимости, так как новый тип памяти очень сложен в производстве, а значит и дорог. Ведь хотя применение HBM и обойдется дешевле, чем аналогичный стандарт stacked-памяти HMC, но такое решение явно дороже, чем подобный же объем GDDR5, что делает использование большего количества стеков еще менее практичным.

С одной стороны, объем видеопамяти в 4 ГБ до сих пор очень часто применяется даже в топовых решениях, и его может быть достаточно во многих условиях. С другой, самые современные игры вроде GTA V уже частенько желают больше памяти, чем 4 ГБ, особенно в самых высоких разрешениях, вроде 4K. И при нехватке видеопамяти под буферы, игровые текстуры будут то загружаться в память, то освобождать ее, что вызовет снижение производительности и неплавность частоты кадров. А ведь сейчас именно 4K и VR являются главными двигателями индустрии, и все они лишь увеличивают требования к объему видеопамяти. Как и многомониторные конфигурации, поддержкой которых славятся решения компании AMD.

С другой, самые современные игры вроде GTA V уже частенько желают больше памяти, чем 4 ГБ, особенно в самых высоких разрешениях, вроде 4K. И при нехватке видеопамяти под буферы, игровые текстуры будут то загружаться в память, то освобождать ее, что вызовет снижение производительности и неплавность частоты кадров. А ведь сейчас именно 4K и VR являются главными двигателями индустрии, и все они лишь увеличивают требования к объему видеопамяти. Как и многомониторные конфигурации, поддержкой которых славятся решения компании AMD.

Получается, что для игр решение с 4 ГБ HBM-памяти может быть спорным. А что с профессиональным рынком вычислений и рендеринга? Ситуация аналогичная, даже еще хуже — для профессионального рынка поддержка всего лишь 4 ГБ памяти — как насмешка, ведь для сложного рендеринга в реальном времени и множества вычислительных задач лимит в 4 ГБ памяти будет смерти подобен! Тем более, что конкурент предлагает полупрофессиональные и профессиональные решения, имеющие пусть и не столь шуструю память, но зато в три раза большего объема — 12 ГБ у той же Geforce GTX Titan X.

Может быть в AMD решились на применение такой памяти слишком рано и нужно было подождать коммерческой доступности второго поколения HBM-памяти, ведь его главное отличие в том, что будет удвоено число чипов DRAM на стек, а значит возрастет объем до 2 ГБ на стек, что позволит выпустить графический чип с 8 ГБ видеопамяти. Но это будет возможно лишь в будущем году, не раньше, и второе поколение будет доступно не только AMD, а они явно хотят стать первыми.

Заключение

Будущие стандарты памяти серьезно изменят несколько рынков, в том числе и графических процессоров, ведь тот же стандарт HBM предлагает значительно большую ПСП и заметное улучшение энергоэффективности. Такие типы памяти откроют для GPU новые возможности по росту пропускной способности — одного из важнейших препятствий для дальнейшего повышения производительности в графических задачах.

В стандарте памяти HBM используются 128-битные каналы, которые можно стыковать друг с другом до восьми микросхем в стопке, получая 1024-битный или даже 2048-битный интерфейс на каждый стек в итоге. Полная пропускная способность стека при этом будет 128 ГБ/с или 256 ГБ/с в зависимости от количества чипов памяти в нем: четыре или восемь. И будущие графические процессоры с HBM-памятью смогут иметь ПСП от 512 ГБ/с до 1 ТБ/с, тогда как текущий рекорд равен 336 ГБ/с (для Geforce GTX Titan Black и Titan X).

Полная пропускная способность стека при этом будет 128 ГБ/с или 256 ГБ/с в зависимости от количества чипов памяти в нем: четыре или восемь. И будущие графические процессоры с HBM-памятью смогут иметь ПСП от 512 ГБ/с до 1 ТБ/с, тогда как текущий рекорд равен 336 ГБ/с (для Geforce GTX Titan Black и Titan X).

В общем смысле, стандарт stacked-памяти HBM абсолютно точно можно считать благом — он даст как повышенную производительность, так и снижение потребления, а энергоэффективность является самым важным параметром для всех современных решений. Гипотетическому GPU, чтобы достичь 512 ГБ/с, возможных с применением HBM первого поколения, нужно иметь 512-битную шину памяти и GDDR5-память, работающую на эффективной частоте в 8 ГГц. Теоретически, это вполне достижимые показатели, но при этом чипы памяти будут потреблять энергии порядка 50 Вт, в отличие от 15 Вт потребления аналогичной HBM-памятью. А ведь эти 35 Вт разницы можно отдать в пользу GPU, чтобы его исполнительные устройства работали на более высокой частоте, например. А для и так немало потребляющих графических процессоров архитектуры GCN 1.x это довольно важно.

А для и так немало потребляющих графических процессоров архитектуры GCN 1.x это довольно важно.

Но вот что касается конкретно применения первого поколения HBM-памяти в будущем топовом графическом процессоре компании AMD, тут есть одно «но» — ограничение по объему видеопамяти с HBM первого поколения довольно жесткое. Как мы предполагаем, на следующую видеокарту AMD смогут установить всего лишь 4 ГБ HBM-памяти, что для продукта из топового сегмента крайне мало. Особенно с учетом популяризации 4K-разрешения, систем виртуальной реальности и распространения многомониторных конфигураций. И уж тем более — в требовательных играх, которые вполне могут использовать 5-6 ГБ и даже больше.

Еще один момент — да, у памяти стандарта HBM даже в первом поколении есть явное преимущество по энергоэффективности, которое можно потратить или в сторону повышения ПСП или снижения потребления (для мобильных GPU, например) — это надо решать в каждом конкретном случае отдельно. Но вот стоит ли овчинка выделки в первом поколении при не столь уж существенной разнице по ПСП для топовых решений? Ведь проблем при производстве добавляется очень много, да и себестоимость растет.

Что касается использования stacked-памяти в общем, то AMD не станет компанией, первой выпустившей на рынок продукт с использованием многослойной памяти, так как Samsung и Hynix уже выпускают модули DDR4 высокой плотности, использующие подобное решение и соединения типа TSV, но AMD точно станет первой на рынке с графическим процессором, поддерживающим HBM-память.

Хотя у первого поколения HBM есть явные недостатки, но новый стандарт абсолютно точно станет будущим общепринятым стандартом для видеопамяти по крайней мере для топовых GPU. Новая память даже первого поколения имеет значительное преимущество по производительности в плане пропускной способности, а также энергоэффективности.

Более того, компания AMD будет не просто первым производителем графического процессора с памятью стандарта HBM, но единственным производителем, кто освоит HBM память первого поколения. Ведь стандартом, одобренным комитетом JEDEC, станет лишь второе поколение — HBM2, а HBM первого поколения будет использоваться исключительно совместно AMD и Hynix. И до появления продуктов, использующих уже второе поколение HBM (HBM2), у AMD есть примерно с год форы по применению этой технологии, за это время только в их GPU мы увидим такую память. Вполне возможно, кстати, что и второе поколение они освоят быстрее конкурента — ведь опыт по работе с HBM-стеками то у них уже будет.

И до появления продуктов, использующих уже второе поколение HBM (HBM2), у AMD есть примерно с год форы по применению этой технологии, за это время только в их GPU мы увидим такую память. Вполне возможно, кстати, что и второе поколение они освоят быстрее конкурента — ведь опыт по работе с HBM-стеками то у них уже будет.

Но компания AMD постарается получить преимущество и в первом же графическом процессоре с поддержкой HBM. Хотя AMD пока что не разглашает подробных данных о производительности подсистемы памяти будущего графического процессора, зато о планах на использование HBM-памяти даже в будущих APU они рассказывают охотно, хотя это пока что является лишь теоретической возможностью.

Но когда применение HBM станет сравнительно недорогим, от AMD можно ожидать выпуска как бюджетных GPU с такой памятью, так и даже гибридных чипов APU с подобным типом памяти, так как нынешние поколения APU сильно страдают в том числе из-за малой ПСП их 128-битных интерфейсов памяти и применения DDR3-памяти. Представьте себе APU с несколькими CPU-ядрами нового поколения, относительно мощным GPU-ядром и общей HBM-памятью с огромной ПСП — это мечта многих разработчиков, и особенно хорошо такой чип подойдет для игровых консолей. Но для начала давайте дождемся топового GPU с памятью HBM — благо, ждать осталось совсем недолго.

Представьте себе APU с несколькими CPU-ядрами нового поколения, относительно мощным GPU-ядром и общей HBM-памятью с огромной ПСП — это мечта многих разработчиков, и особенно хорошо такой чип подойдет для игровых консолей. Но для начала давайте дождемся топового GPU с памятью HBM — благо, ждать осталось совсем недолго.

Как увеличить выделенную видеопамять (VRAM) в Windows 10 и 11

Видите ошибки, связанные с выделенной видеопамятью на вашем ПК с Windows? Изо всех сил пытаетесь запускать программы с интенсивным использованием графики, такие как видеоредакторы и новые видеоигры? Вам может понадобиться больше видеопамяти (VRAM).

Но что это вообще такое и как можно увеличить VRAM? Читайте все, что вам нужно знать о видеопамяти в Windows 10 и 11.

Что такое выделенная видеопамять (VRAM)?

Видеопамять (или VRAM, произносится как «VEE-ram») — это особый тип оперативной памяти, который работает с графическим процессором вашего компьютера или графическим процессором.

Графический процессор — это микросхема графической карты вашего компьютера (также называемая видеокартой), которая отвечает за отображение изображений на экране. Хотя это технически неверно, термины GPU и видеокарта часто используются как синонимы.

В вашей видеопамяти хранится информация, необходимая графическому процессору, включая игровые текстуры и световые эффекты. Это позволяет графическому процессору быстро получать доступ к информации и выводить видео на ваш монитор.

Использование видеопамяти для этой задачи намного быстрее, чем использование вашей системной памяти, потому что видеопамять находится рядом с графическим процессором в графической карте. VRAM создана для этой высокоинтенсивной цели и поэтому является «специальной».

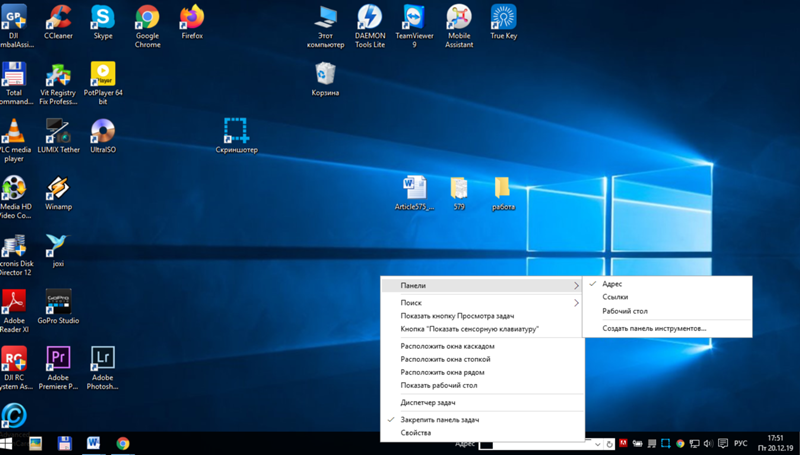

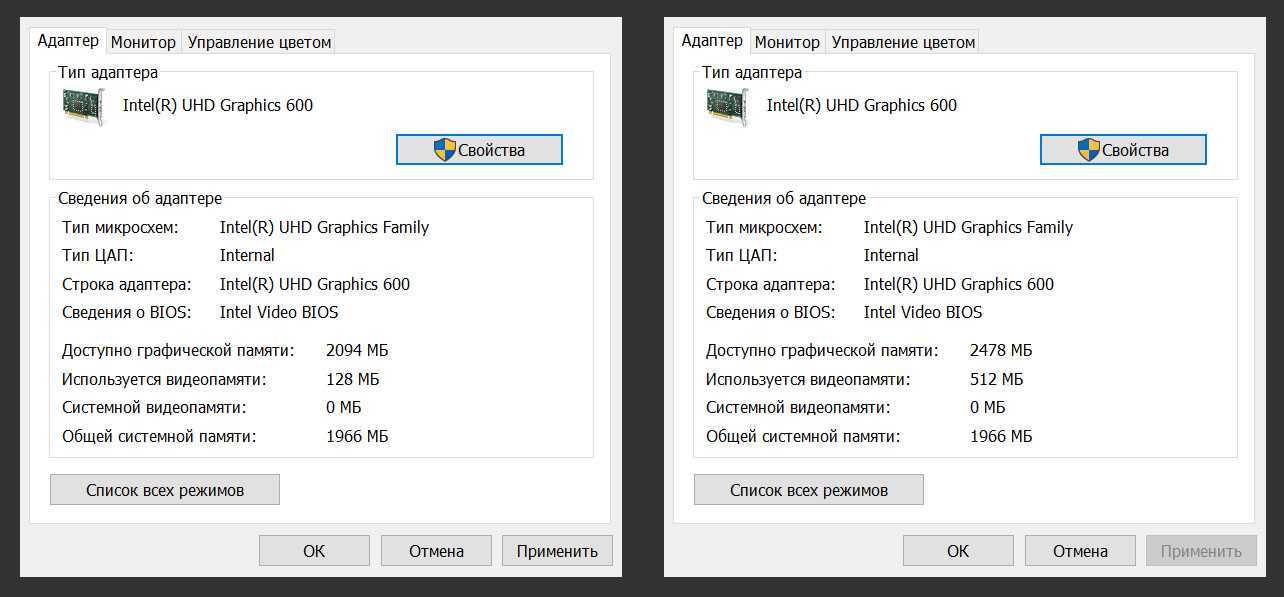

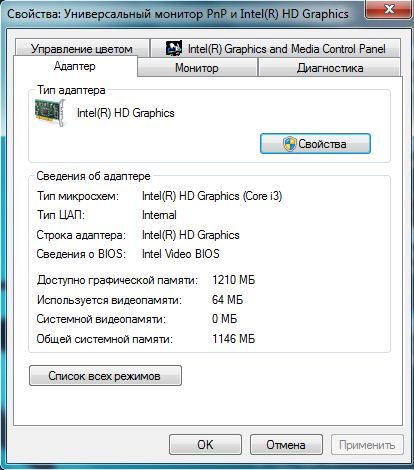

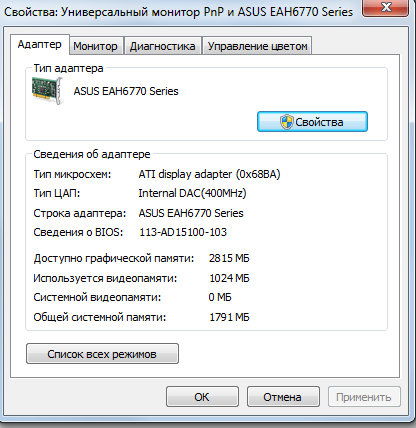

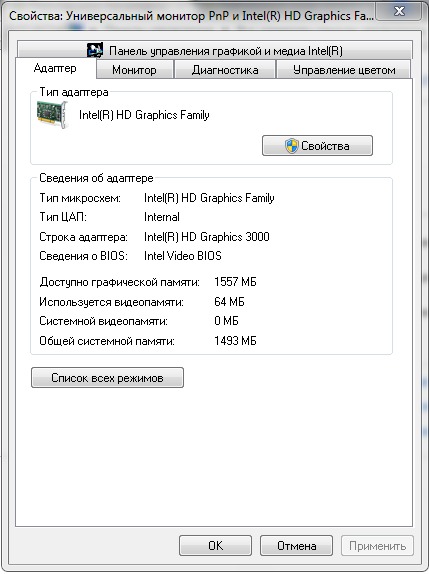

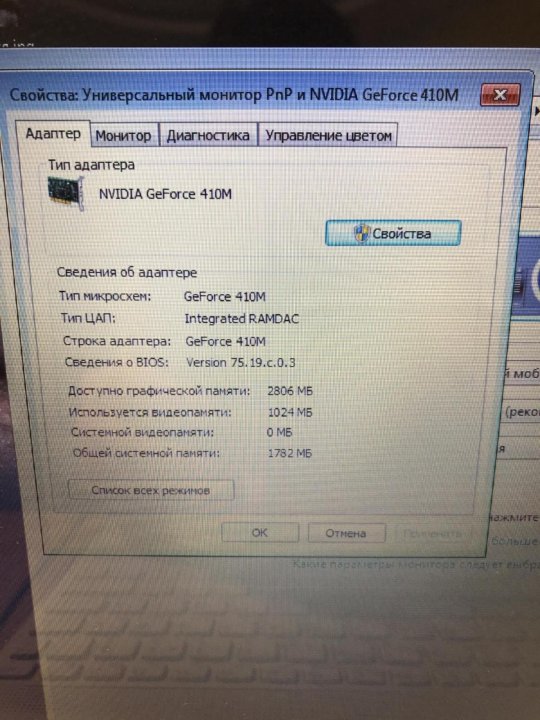

Как проверить видеопамять в Windows 10 и Windows 11

Вы можете легко просмотреть объем видеопамяти в Windows 10, выполнив следующие действия:

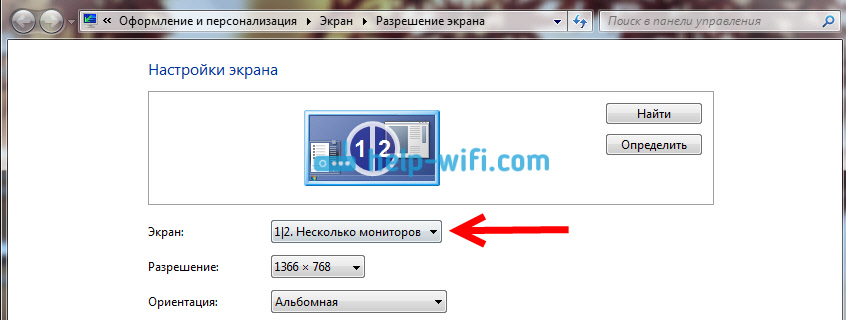

- Откройте меню Настройки , нажав Win + I .

- Выберите запись System , затем нажмите Display на левой боковой панели.

- Прокрутите вниз и щелкните текст Дополнительные параметры дисплея внизу.

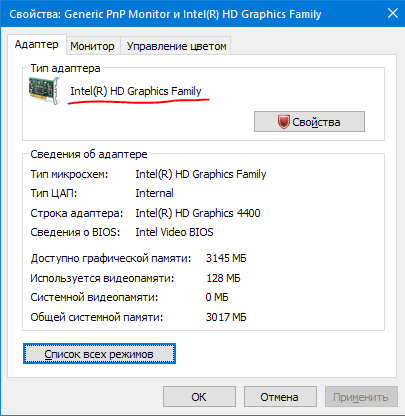

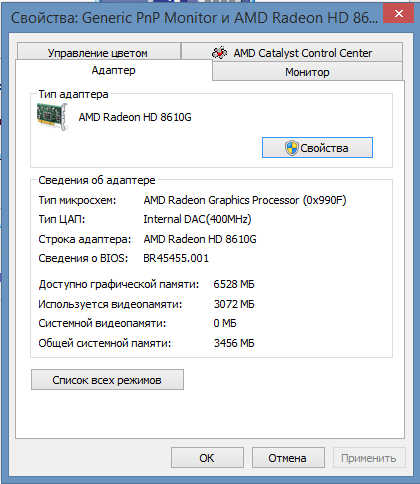

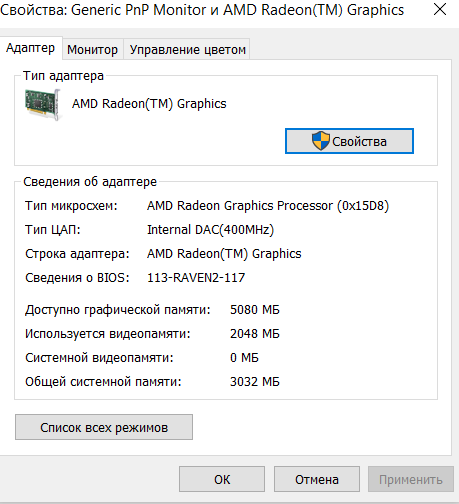

- В появившемся меню выберите монитор, для которого вы хотите просмотреть настройки (при необходимости). Затем нажмите Показать свойства адаптера текст внизу.

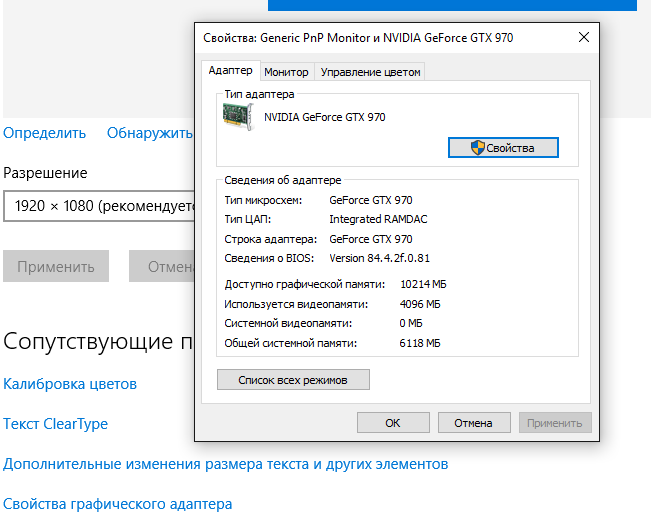

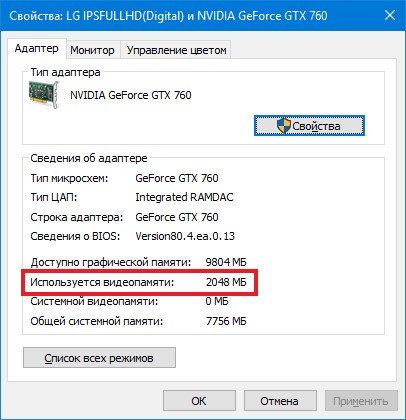

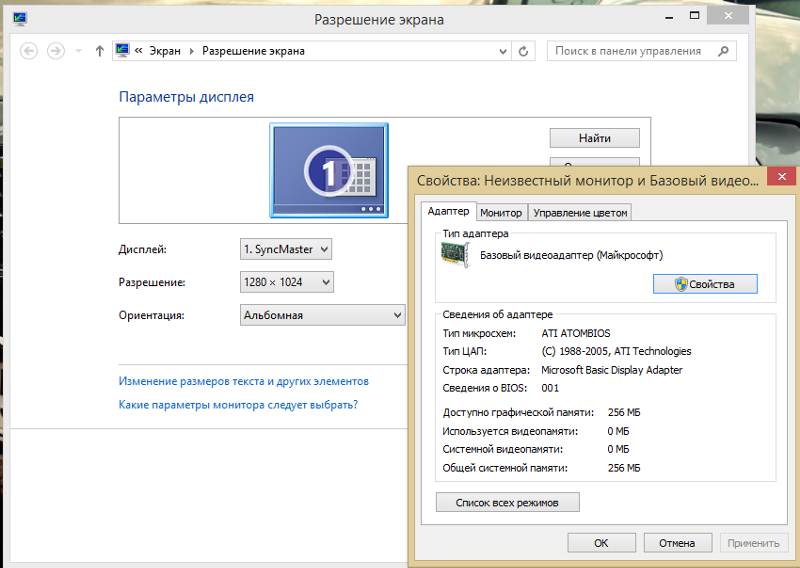

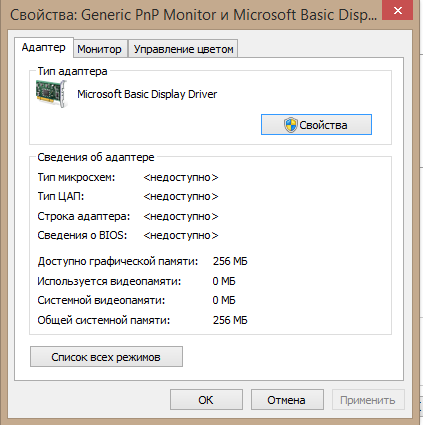

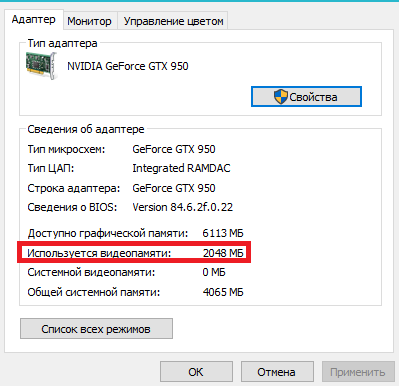

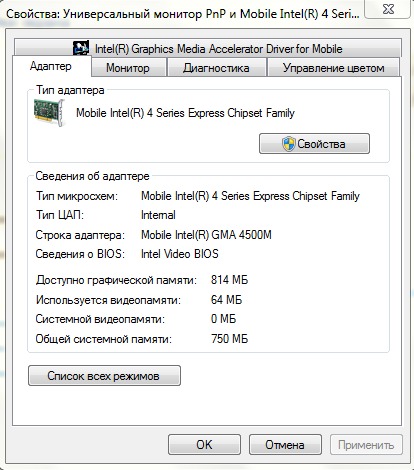

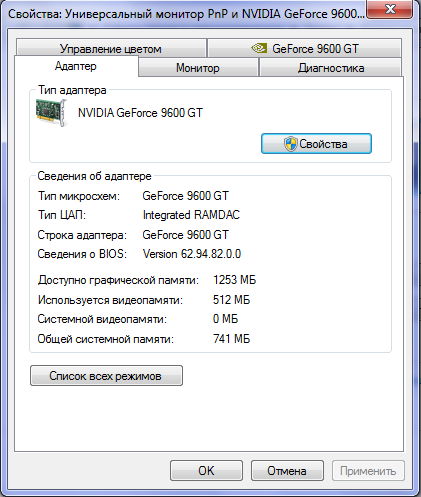

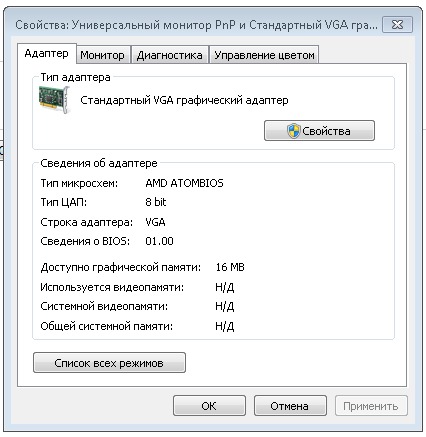

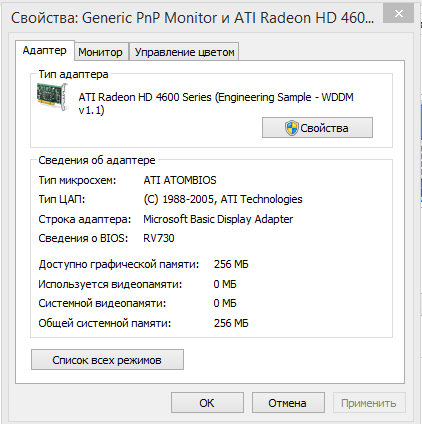

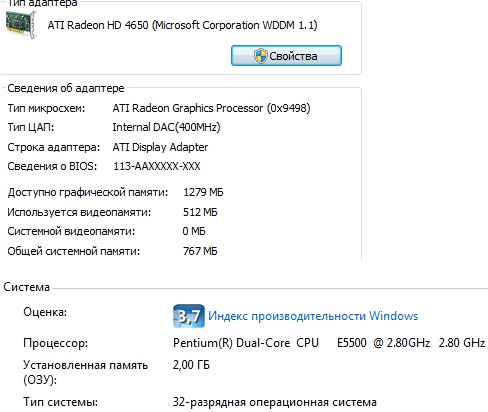

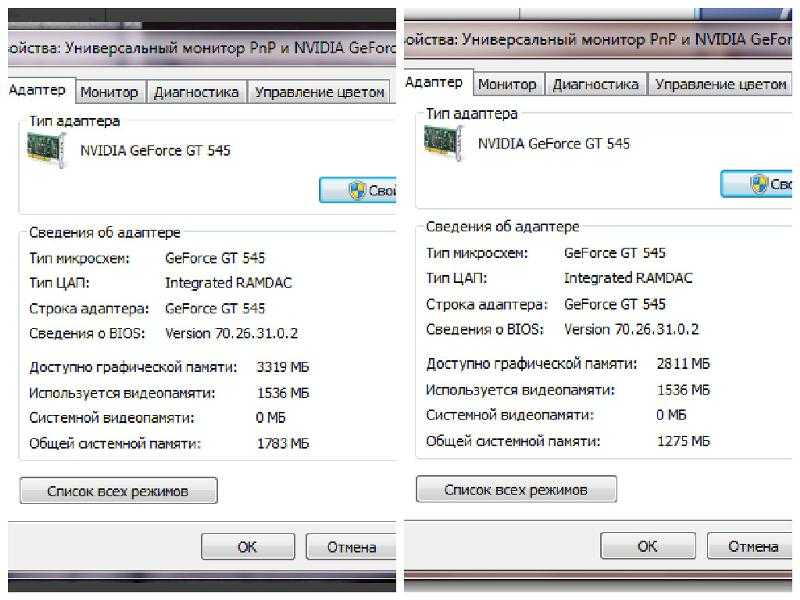

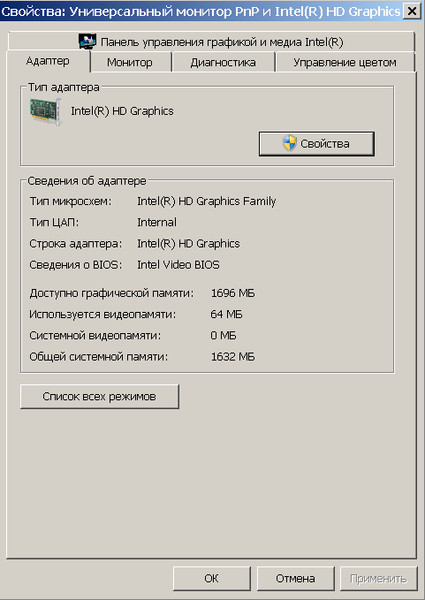

- В новом окне рядом с выделенной видеопамятью вы увидите текущий объем видеопамяти.

Чтобы открыть это меню в Windows 11, выберите «Настройки» > «Система» > «Дисплей» > «Расширенный дисплей» . Затем выберите дисплей и щелкните Свойства адаптера дисплея .

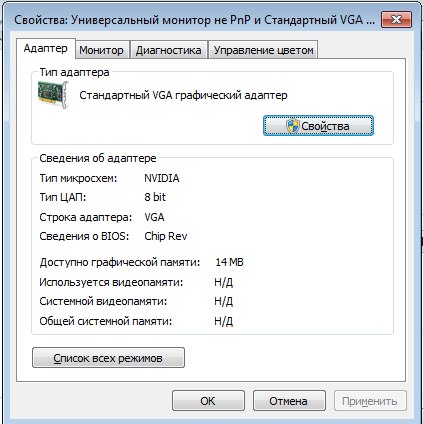

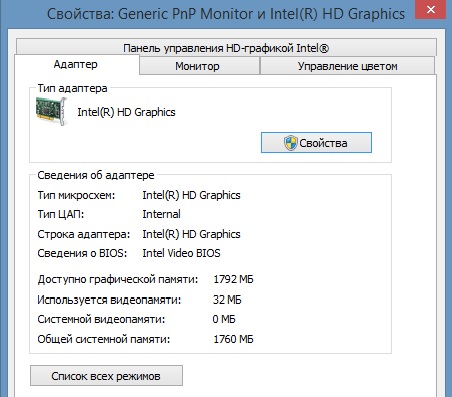

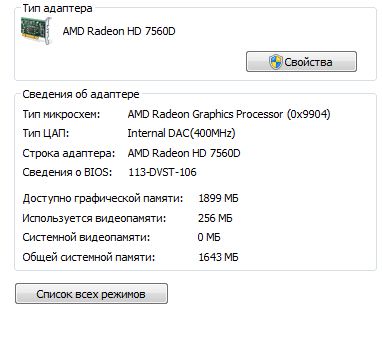

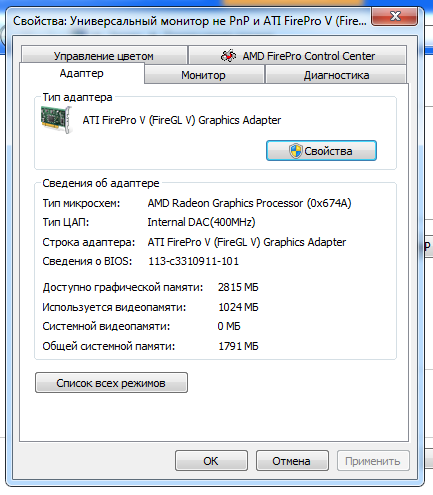

В разделе Adapter Type вы увидите название вашего Nvidia или AMD 9.0012 видеокарта, в зависимости от того, какое у вас устройство. Если вы видите AMD Accelerated Processing Unit или Intel HD Graphics (более вероятно), вы используете интегрированную графику. Подробнее об этом мы расскажем ниже.

Подробнее об этом мы расскажем ниже.

Как увеличить VRAM в Windows

Лучший способ увеличить объем видеопамяти — это купить новую или лучшую видеокарту. Если вы используете встроенную графику и страдаете от низкой производительности, обновление до выделенной карты (даже одной из лучших бюджетных видеокарт) сотворит чудеса с вашим видеовыходом.

Однако, если это не вариант для вас (например, на ноутбуках), вы можете увеличить объем выделенной видеопамяти двумя способами.

Как увеличить VRAM в BIOS

Первый способ — настроить распределение видеопамяти в UEFI или BIOS вашего компьютера. Войдите в BIOS и найдите в меню опцию Advanced Features , Advanced Chipset Features или аналогичную. Внутри этого найдите вторичную категорию, которая называется что-то вроде Настройки графики 9.0012 , Настройки видео или Объем общей памяти VGA .

Должен содержать параметр для настройки объема памяти, выделяемой графическому процессору. По умолчанию обычно 128MB ; попробуйте увеличить это значение до 256 МБ или 512 МБ , если у вас достаточно свободного места.

По умолчанию обычно 128MB ; попробуйте увеличить это значение до 256 МБ или 512 МБ , если у вас достаточно свободного места.

Однако не каждый ЦП или BIOS имеет эту опцию. Если вы не можете изменить его, есть обходной путь, который может вам помочь.

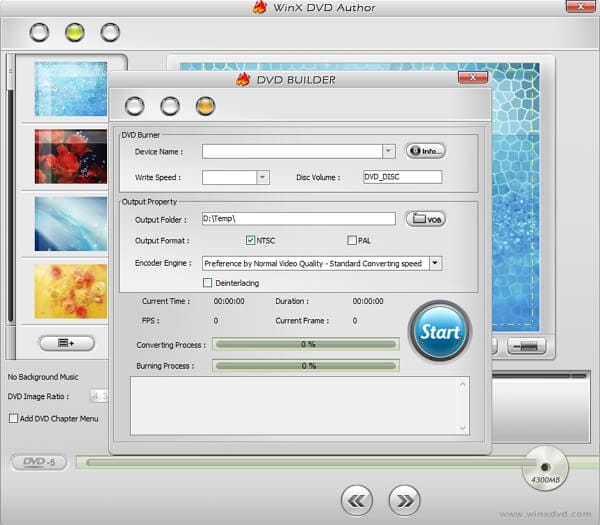

Имитация увеличения VRAM в Windows

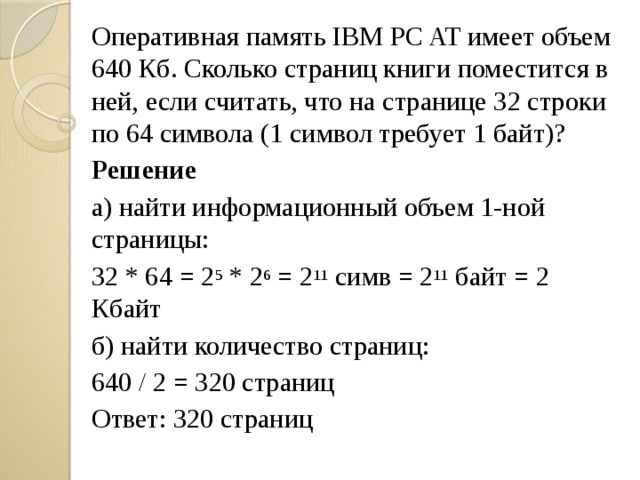

Поскольку большинство интегрированных графических решений автоматически настраиваются на использование необходимого объема оперативной памяти системы, подробности, указанные в Окно свойств адаптера не имеет большого значения. На самом деле для интегрированной графики значение Dedicated Video Memory является полностью вымышленным. Система сообщает об этом фиктивном значении просто для того, чтобы игры что-то видели, когда проверяли, сколько у вас видеопамяти.

Таким образом, вы можете изменить значение реестра, чтобы изменить объем VRAM, который ваша система сообщает играм. На самом деле это не увеличивает вашу VRAM; он просто изменяет это фиктивное значение. Если игра отказывается запускаться из-за того, что у вас «недостаточно видеопамяти», увеличение этого значения может исправить это.

На самом деле это не увеличивает вашу VRAM; он просто изменяет это фиктивное значение. Если игра отказывается запускаться из-за того, что у вас «недостаточно видеопамяти», увеличение этого значения может исправить это.

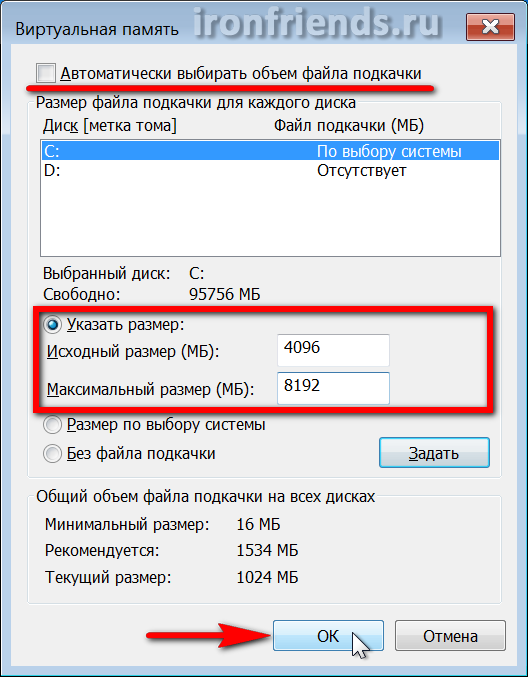

Откройте окно редактора реестра, введя regedit в меню «Пуск». Помните, что вы можете испортить свою систему, если измените неправильные значения, поэтому будьте осторожны при редактировании реестра.

Отправляйтесь в следующее место:

HKEY_LOCAL_MACHINE\Программное обеспечение\Intel

Щелкните правой кнопкой мыши папку Intel на левой панели и выберите New > Key . Назовите этот ключ GMM . Как только вы это сделаете, выберите новые GMM слева и щелкните правой кнопкой мыши внутри правой стороны.

Выберите Создать > DWORD (32-разрядное) Значение . Назовите этот DedicatedSegmentSize и присвойте ему значение, обязательно выбрав параметр Decimal . В мегабайтах минимальное значение 0 (отключение записи), максимальное 512 . Установите это значение, перезагрузите компьютер и посмотрите, поможет ли это игре работать лучше. Если нет, попробуйте более высокое значение и повторите.

В мегабайтах минимальное значение 0 (отключение записи), максимальное 512 . Установите это значение, перезагрузите компьютер и посмотрите, поможет ли это игре работать лучше. Если нет, попробуйте более высокое значение и повторите.

Эти методы не гарантируют устранения проблем с видеопамятью, но их все же стоит попробовать, если у вас возникнут проблемы. Если у вас недостаточно оперативной памяти и у вас возникают проблемы с запуском игр с интегрированной графикой, попробуйте добавить дополнительную оперативную память или освободить ее для использования встроенной графикой. Со встроенной графикой ваша система будет использовать стандартную оперативную память вместо выделенной видеопамяти в графической карте, поэтому вам нужно много памяти для плавной работы игр.

Как и в случае с большинством аппаратных задач, модернизация оперативной памяти или видеокарты часто бывает сложной на ноутбуке, но легко выполняется на настольном компьютере.

Для каких задач требуется видеопамять?

Прежде чем мы поговорим о конкретных значениях для видеопамяти, мы должны упомянуть, какие аспекты игр и других приложений с интенсивным использованием графики используют больше всего видеопамяти.

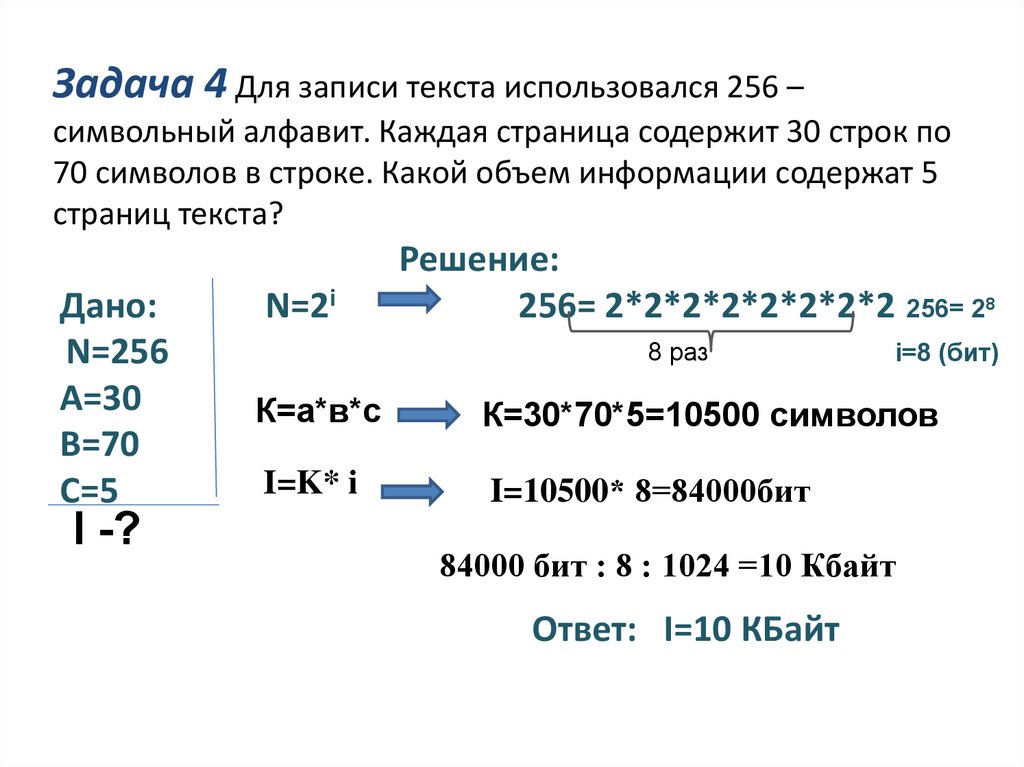

Важным фактором потребления видеопамяти является разрешение вашего монитора (точнее, разрешение, в котором вы запускаете игру). В видеопамяти хранится буфер кадров, в котором хранится изображение до и во время его отображения графическим процессором на экране. Дисплеи более высокого качества (например, монитор 4K HDR) используют больше видеопамяти, поскольку для отображения изображений с более высоким разрешением требуется больше пикселей.

Помимо изображения на мониторе, текстуры в игре могут существенно повлиять на объем необходимой вам видеопамяти. Большинство современных компьютерных игр позволяют точно настроить графические параметры для повышения производительности или визуального качества.

Возможно, вы сможете играть в игру, выпущенную несколько лет назад, с настройками Low или Medium с более дешевой картой (или даже со встроенной графикой). Но для качества High или Ultra или пользовательских модов, которые делают игровые текстуры даже лучше, чем обычно, потребуется много видеопамяти.

Но для качества High или Ultra или пользовательских модов, которые делают игровые текстуры даже лучше, чем обычно, потребуется много видеопамяти.

Функции украшения, такие как сглаживание (сглаживание неровных краев), также используют больше видеопамяти из-за необходимости дополнительных пикселей. Если вы играете на двух мониторах одновременно, это еще более интенсивно.

Для определенных игр также может потребоваться разное количество видеопамяти в зависимости от их графической точности. Старая мультяшная игра, такая как Team Fortress 2, не слишком требовательна к графике, но игра с множеством продвинутых световых эффектов и детализированных текстур, такая как Cyberpunk 2077, требует больше ресурсов.

И наоборот, дешевой карты всего с 2 ГБ видеопамяти (или даже встроенной графики с 8 ГБ+ системной памяти) достаточно для игры в компьютерные игры 20-летней давности. Игры того времени не имели в своем распоряжении современного объема оперативной памяти.

Даже если вы не заинтересованы в играх, некоторые популярные программы также требуют достаточного объема видеопамяти. Программное обеспечение для 3D-дизайна, такое как AutoCAD, особенно интенсивное редактирование в Photoshop и редактирование высококачественного видео — все это пострадает, если у вас недостаточно видеопамяти.

Сколько видеопамяти мне нужно?

Понятно, что идеального объема видеопамяти для всех не существует. Тем не менее, мы можем дать некоторые основные рекомендации о том, сколько видеопамяти вы должны стремиться к видеокарте.

- 1–2 ГБ видеопамяти: Эти карты обычно стоят менее 100 долларов. Они предлагают лучшую производительность, чем встроенная графика, но не могут справиться с большинством современных игр при настройках выше среднего. Приобретайте карту с таким объемом видеопамяти только в том случае, если вы хотите играть в старые игры, которые не будут работать со встроенной графикой. Не рекомендуется для редактирования видео или работы с 3D.

- 3–6 ГБ видеопамяти: Эти карты среднего уровня подходят для умеренных игр или довольно интенсивного редактирования видео. Вы не сможете использовать ультра-безумные пакеты текстур, но вы можете рассчитывать на то, что сможете играть в современные игры с разрешением 1080p без особых проблем. 6 ГБ — более перспективный вариант, чем что-то вроде 4 ГБ.

- 8–12 ГБ видеопамяти и больше: Высокопроизводительные видеокарты с таким объемом памяти предназначены для серьезных геймеров. Если вы хотите играть в новейшие игры с разрешением 4K, вам нужна карта с большим объемом видеопамяти.

Однако к приведенным выше обобщениям следует относиться с недоверием . Производители видеокарт добавляют соответствующий объем видеопамяти в карту в зависимости от мощности графического процессора.

Таким образом, дешевая видеокарта за 75 долларов будет иметь небольшой объем видеопамяти, а видеокарта за 500 долларов — намного больше. Если слабый графический процессор недостаточно мощный для рендеринга видео, для хранения которого требуется 8 ГБ видеопамяти, то иметь такой объем видеопамяти на карте — пустая трата времени.

Если слабый графический процессор недостаточно мощный для рендеринга видео, для хранения которого требуется 8 ГБ видеопамяти, то иметь такой объем видеопамяти на карте — пустая трата времени.

Крайности не являются проблемой для VRAM. Вам не нужна первоклассная карта стоимостью 800 долларов с 12 ГБ видеопамяти, чтобы играть в 2D-инди-платформеры. На самом деле вам нужно беспокоиться только о том, сколько VRAM нужно получить, когда карта, которую вы хотите купить, доступна в нескольких конфигурациях VRAM. VRAM — не единственный фактор, который должен учитываться при выборе графического процессора.

Общие проблемы с видеопамятью

Помните, что, как и в случае с обычной оперативной памятью, больший объем видеопамяти не всегда означает более высокую производительность. Если ваша карта имеет 4 ГБ видеопамяти, а вы играете в игру, которая использует только 2 ГБ, обновление карты до 8 ГБ не даст ничего заметного.

И наоборот, нехватка видеопамяти — огромная проблема. Если VRAM заполнится, система будет полагаться на стандартную оперативную память, и производительность сильно пострадает. Вы будете страдать от более низкой частоты кадров, всплывающих окон текстур и других побочных эффектов. В крайних случаях игра может замедлиться и стать неиграбельной (все, что ниже 30 кадров в секунду).

Если VRAM заполнится, система будет полагаться на стандартную оперативную память, и производительность сильно пострадает. Вы будете страдать от более низкой частоты кадров, всплывающих окон текстур и других побочных эффектов. В крайних случаях игра может замедлиться и стать неиграбельной (все, что ниже 30 кадров в секунду).

Помните, что VRAM — это только один из факторов производительности. Если у вас недостаточно мощный процессор, рендеринг 4K-видео будет длиться вечно. Недостаток системной оперативной памяти не позволяет запускать множество программ одновременно, а использование механического жесткого диска также серьезно ограничивает производительность вашей системы. А некоторые более дешевые видеокарты используют медленную видеопамять DDR3, которая уступает используемым в современных картах DDR6 и DDR5.

Лучший способ узнать, какая именно видеокарта и объем видеопамяти вам подходят, — это поговорить со знающим человеком. Спросите друга, который знает о новейших графических картах, или опубликуйте сообщение на форуме, таком как Reddit или Tom's Hardware, с вопросом, подойдет ли конкретная карта для ваших нужд.

Понимание VRAM со встроенной графикой

До сих пор в нашем обсуждении предполагалось, что на вашем ПК установлена выделенная графическая карта. Большинство людей, которые собирают свой собственный компьютер или покупают готовый игровой ПК, имеют настольный компьютер с видеокартой. Некоторые более мощные ноутбуки даже оснащены выделенной видеокартой.

Но бюджетные настольные компьютеры или стандартные ноутбуки не включают видеокарты — вместо этого они используют встроенную графику.

Интегрированное графическое решение означает, что графический процессор находится на том же кристалле, что и ЦП, и использует общую системную оперативную память вместо использования собственной выделенной видеопамяти. Это бюджетное решение, которое позволяет ноутбукам выводить базовую графику без необходимости использования места и энергозатратной видеокарты. Но встроенная графика плоха для игр и графически интенсивных задач.

Производительность встроенной графики зависит от вашего процессора. Новые процессоры Intel с Intel Iris Xe Graphics более мощные, чем их более дешевые и старые аналоги, но все же бледнеют по сравнению с выделенной графикой.

Новые процессоры Intel с Intel Iris Xe Graphics более мощные, чем их более дешевые и старые аналоги, но все же бледнеют по сравнению с выделенной графикой.

Если вашему компьютеру не более нескольких лет, у вас не должно возникнуть проблем с просмотром видео, играми в игры с низкой интенсивностью и работой в основных приложениях для редактирования фотографий и видео со встроенной графикой. Однако играть в новейшие графически впечатляющие игры с комфортной частотой кадров с интегрированной графикой невозможно.

Теперь вы понимаете видеопамять

Теперь вы знаете, что такое видеопамять, сколько вам нужно и как ее увеличить. В конце концов, однако, помните, что видеопамять — это небольшой аспект общей производительности вашего компьютера. Слабый графический процессор не будет работать хорошо даже с большим количеством видеопамяти.

Таким образом, если вы хотите повысить игровую и графическую производительность, вам, вероятно, потребуется сначала обновить видеокарту, процессор и/или оперативную память — видеопамять должна разобраться сама, когда вы все это сделаете.

Оптимизация производительности Photoshop

Попробуйте советы и приемы, описанные в этом документе, если Photoshop работает на вашем компьютере медленнее, чем ожидалось

- Расширенные шаги для повышения производительности

- Настройка параметров производительности

- Функции тонкой настройки для повышения производительности

- Фотошоп

Широкие возможности для повышения производительности

Настройки каждого пользователя уникальны, и для достижения максимальной производительности Photoshop может потребоваться различное сочетание методов. Из предложений, задокументированных в этой статье, подумайте, какие из них следует реализовать в контексте настройки вашего компьютера, типов файлов, которые вы используете, и вашего конкретного рабочего процесса. Существует четыре основных способа повлиять на производительность Photoshop — оптимизация настройки оборудования, оптимизация операционной системы для Photoshop, настройка параметров, связанных с производительностью, и точная настройка функций Photoshop.

Самый простой способ повысить производительность, не тратя денег, — установить настройки Photoshop и точно настроить его функции, чтобы использовать преимущества вашей работы и типов файлов, с которыми вы обычно работаете.

Самый радикальный способ повысить производительность — это инвестировать в более быстрое и мощное оборудование. Ваш компьютер должен соответствовать определенным минимальным системным требованиям для оптимальной работы Photoshop. Запуск Photoshop на маломощном или неподдерживаемом оборудовании, например на компьютере с несовместимым графическим процессором (GPU), может привести к проблемам с производительностью.

Настройка параметров производительности

Посмотрите этот короткий видеоролик, чтобы узнать, как быстро оптимизировать параметры производительности в Photoshop.

Photoshop предоставляет набор настроек («Настройки» > «Производительность»), которые помогут вам оптимально использовать ресурсы вашего компьютера, такие как память, кэш, графический процессор, дисплеи и т. д. В зависимости от вашего основного варианта использования Photoshop и типов документов, с которыми вы обычно работаете, вам могут подойти различные комбинации этих настроек.

д. В зависимости от вашего основного варианта использования Photoshop и типов документов, с которыми вы обычно работаете, вам могут подойти различные комбинации этих настроек.

Дополнительные настройки, такие как рабочие диски, доступные на других вкладках диалогового окна «Настройки», также могут напрямую влиять на скорость и стабильность работы вашего компьютера.

Параметры производительности в Photoshop

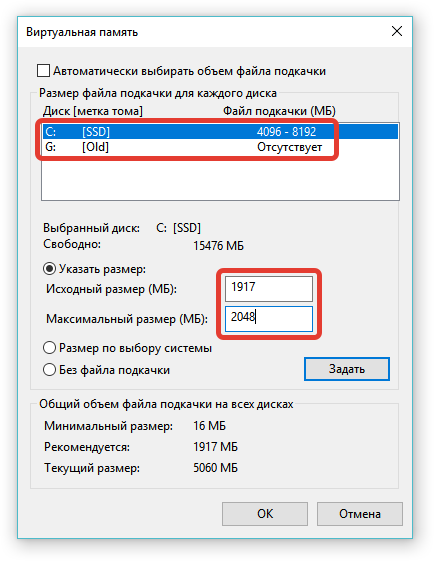

Настройка памяти, выделенной для Photoshop

Вы можете повысить производительность, увеличив объем памяти/ОЗУ, выделенной для Photoshop. В области «Использование памяти» диалогового окна «Параметры производительности» («Установки» > «Производительность») указано, сколько ОЗУ доступно для Photoshop. Он также показывает идеальный диапазон выделения памяти Photoshop для вашей системы.

По умолчанию Photoshop использует 70% доступной оперативной памяти .

- Увеличьте объем ОЗУ, выделенный для Photoshop, изменив значение в поле Разрешить Photoshop использовать .

Или отрегулируйте ползунок «Использование памяти».

Или отрегулируйте ползунок «Использование памяти». - Перезапустите Photoshop, чтобы изменения вступили в силу.

Чтобы найти идеальное распределение оперативной памяти для вашей системы, изменяйте его с шагом 5% и следите за производительностью в индикаторе эффективности.

Мы не рекомендуем выделять более 85% памяти вашего компьютера для Photoshop. Это может повлиять на производительность, так как не останется памяти для других важных системных приложений.

Если в Photoshop возникают ошибки нехватки оперативной памяти или памяти, попробуйте увеличить объем оперативной памяти, выделенной для Photoshop. Однако установка слишком большого объема ОЗУ для Photoshop (> 85%) может повлиять на производительность других запущенных приложений, что сделает вашу систему нестабильной.

Лучшим решением этой проблемы является увеличение объема оперативной памяти на вашем компьютере. Уточните у производителя вашего компьютера характеристики оперативной памяти и совместимость.

Настройка уровней кэша

Основы кэширования

Photoshop использует кэширование изображений для ускорения перерисовки документов с высоким разрешением во время работы с ними. Вы можете указать до восьми уровней кэшированных данных изображений и выбрать один из четырех доступных размеров фрагментов кэша.

Увеличение уровня кэша повышает скорость отклика Photoshop во время работы, хотя загрузка изображений может занять больше времени. Размер фрагмента кэша определяет объем данных, с которыми одновременно работает Photoshop. Большие размеры плиток ускоряют выполнение сложных операций, таких как фильтры повышения резкости. Меньшие изменения, такие как мазки кистью, более чувствительны к меньшим размерам плитки.

Предустановки кэша

В настройках производительности доступны три предустановки кэша. Выберите тот, который соответствует вашему основному варианту использования/цели использования Photoshop:

- Веб-дизайн/дизайн пользовательского интерфейса: Выберите этот вариант, если вы используете Photoshop в основном для веб-дизайна, приложений или дизайна экрана.

Этот параметр подходит для документов, содержащих множество слоев ресурсов с низким и средним размером пикселей.